【新智元导读】昨日,数十架无人机袭击了沙特阿美石油公司的两处石油设施并引发火灾,其中一处是“世界上最大的原油稳定厂”。这次袭击削减了沙特一半的石油生产,是对世界能源供应前所未有的攻击,未来油价会飙升吗?

据外媒报道,昨日凌晨,有数十架无人机袭击了沙特国家石油公司——阿美石油公司的两处(Abqaiq和Khurais)石油设施并引发火灾。其中,Abqaiq被描述为“世界上最大的原油稳定厂”。

视频中,熊熊燃烧的大火照亮了半边天。虽然目前火势已得到控制,但这次袭击对沙特和全球的石油供应是重创。

占全球石油供应量的5%,这次袭击会带来油价飙升吗?

根据阿美石油公司的一份声明,这次袭击将使该国的产量减少570万桶/日,相当于全球石油供应量的5%。

受袭击的Abqaiq和Khurais位置

根据最新的OPEC统计,沙特的石油总产量为每天980万桶,占全球总供应量的10%左右,沙特这次受袭,破坏了该国约一半以上的石油产能。

沙特阿拉伯能源部长Abdulaziz bin Salman表示:该公司目前正在努力恢复损失的石油数量,并将在未来两天内更新公众。这些攻击不仅针对沙特的重要设施,而且还针对全球石油供应及其安全,因此对全球经济构成威胁。

哥伦比亚大学全球能源政策中心的创始主任Jason Bordoff在一份声明中说:“Abqaiq可能是世界上石油供应最关键的设施。石油价格将在这次袭击中飙升。”

国际能源署(IEA)周六表示正在监测沙特阿拉伯的情况:“我们正与沙特当局以及主要的石油生产国和消费国保持联系。目前,市场上的商业库存充足。”

如果沙特阿拉伯的中断时间延长,“受制裁的伊朗供应是潜在石油的另一个来源,”Bordoff说。“但是,美国总统特朗普已经表明,即使在油价飙升的情况下,他也愿意采取最大限度的施压运动。如果说有什么影响的话,那就是地区间针锋相对的升级,从而推高油价的风险已经显著上升。”

美国能源部发言人在一份声明中说,美国能源部长Rick Perry“随时准备”在必要时动用该国的战略石油储备,以稳定石油市场。美国能源部一名官员说,该国的紧急石油供应——上世纪70年代石油危机后形成的一系列储油罐和地下洞穴——拥有6.3亿桶原油。

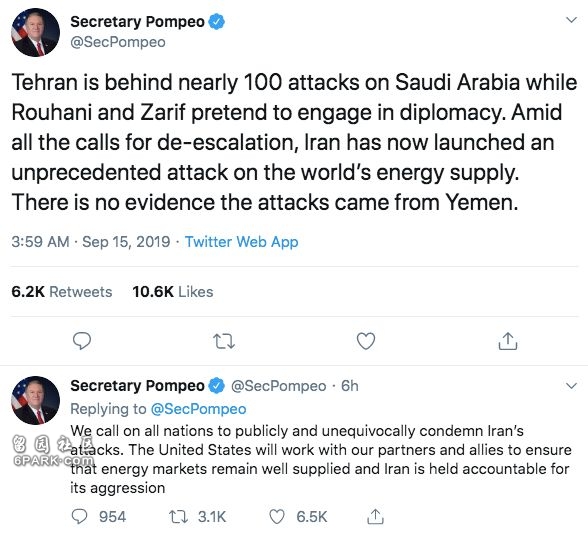

美国国务卿Mike Pompeo直接将袭击事件归咎于支持胡塞叛乱分子的伊朗。“伊朗现在对世界能源供应发动了前所未

有的攻击。没有证据表明这些袭击来自也门,”Pompeo在推特上说。

Pompeo发推谴责伊朗

精准袭击、刺杀总统,无人机被用作武器有多可怕?

在我们担心石油价格要上涨的同时,还有一件事值得我们深思,那就是无人机。

随着技术的进步,无人机被越来越多的用在军事行动中。

2018年8月,委内瑞拉总统在国民警卫队成立81周年庆祝仪式上发表讲话时,一架搭载炸弹的无人机朝他飞去并且引爆,原本整齐列队的士兵像流水一样四处狂奔,电视直播记录下了全过程。总统虽然没受伤害,但至少有7人受伤。

委内瑞拉总统演讲时遭无人机刺杀

这也是人类历史上第一次动用无人机刺杀一国元首。虽然委内瑞拉总统逃过一劫,但谁能保证类似的事件不会重演呢?

在这之前,联合国在特定常规武器公约会议上发布了一段“杀人机器人”视频让人胆寒:

视频中,类似杀人蜂的小型机器人通过面部识别系统辨别射杀对象,结合AI导航技术,飞入会场后躲过演讲人的抓捕,发现目标后迅速将其击毙。

从具体的配置上看,这个机器人配有广角摄像头、战术传感器、面部识别技术,并且在其内装有3克炸药。

精准打击,足以穿透头骨。

视频最后还演示了一段飞行机器人集体攻击人类的画面,通过面部识别定位,轻易杀死了正在上课的一班学生。

美国政府在全球范围内使用升级的军用无人机后,工程师和科学家们警告说,自主机器很容易受到黑客的攻击,它们可能被劫持,进而攻击无辜的人群;并且,它们不可避免地很容易就会被恶意攻击者获得,或者恶意攻击者能够自己制造这类武器。

马斯克、哈萨比斯等2000多人签署宣言:决不允许杀人机器人出现!

“人工智能(AI)将在军事系统中扮演越来越重要的角色,公民、政策制定者和领导人都迫切需要区分AI可接受的用途和不可接受用途。”

去年在瑞典斯德哥尔摩,2000多名AI学者共同签署《致命性自主武器宣言》成为会议国际人工智能联合会议(IJCAI)上的一项重要议题,这也是学界史上最大规模针对“自主武器”的联合签名宣言。

组织这次行动的生命未来研究所的联合创始人、MIT教授迈克思·泰格马克(Max Tegmark)在会上宣布了这项宣言。

泰格马克教授

泰格马克说:“我很高兴看到人工智能的领军人物从对话转向行动,实施一项政治家们迄今未能实施的政策。人工智能有巨大的帮助世界的潜力——我们不能容忍其滥用,并致力于防止其滥用。自主杀人的AI武器就像生化武器一样令人厌恶和不安,我们应该以对待生化武器的方式来处理自主武器。

悉尼新南威尔士大学人工智能科学教授Walsh说:“我们不能把谁生和谁死的决定权交给机器。”因为致命性自主武器系统(lethal autonomous weapon systems),简称“LAWS”,“不具备这样做的道德”。

无人机装上遥控机关枪射击玩具娃娃

在IJCAI会议上,包括马斯克、DeepMind三位创始人都签署了《致命性自主武器宣言》,宣誓不参与致命性自主武器系统(LAWS)的开发、研制工作。

而就在一年前,116名全球人工智能和机器人领域的专家(包括马斯克和谷歌AI专家Mustafa Suleyman)发表联名公开信,呼吁联合国采取行动禁止“自主杀人机器”,称其为“恐怖武器”。“留给我们做准备的时间不多了,”专家们警告说:“一旦这个潘多拉的盒子被打开,就很难再次关上。”

以下是《致命性自主武器宣言》全文:

人工智能(AI)有望在军事系统中发挥越来越大的作用。公民、政策制定者和领导者有必要区分人工智能可接受和不可接受的适用范围。

从这个角度来看,我们签署者达成一致意见:永远不应将人类生命的决定权委托给机器。“道德”是这个立场的一部分,我们不应该让机器为那些应当受处罚的人做出生死决定。另一个强有力的观点是:致命的自主武器,在没有人为干预的情况下选择和参与目标,将危及每个国家和个人的稳定。

众多人工智能研究人员一致认为,若是通过致命的自主武器消除人类生命的风险或困难,它们可能成为一种暴力和压迫的有力工具(尤其是在监视和数据系统相关联时)。此外,致命的自主武器具有与核武器,化学武器和生物武器截然不同的特点,并且单一团体的单方面行动很容易因国际社会缺乏技术工具和全球治理体系而引发军备竞赛。防止发生这种军备竞赛应成为国家和全球安全的优先考虑事项。

我们联名签署人,呼吁各国政府和政府领导人共建一个拥有强大的国际规范、法规和反对致命自主武器法律的未来。这些法律目前是没有的,我们选择保持高标准:我们既不参与也不支持致命自主武器的开发,制造,贸易往来或使用。我们要求技术公司和组织以及领导者,政策制定者和其他个人加入我们的承诺。

当无人机被用作杀人、破坏的武器,对于全人类来说何尝不是一种浩劫呢?

参考链接:https://www.cnn.com/2019/09/14/business/saudi-oil-output-impacted-drone-attack/index.html