AI春晚GTC开幕,皮衣老黄再次燃爆全场。

时隔两年,英伟达官宣新一代Blackwell架构,定位直指“新工业革命的引擎” ,“把AI扩展到万亿参数”。

作为架构更新大年,本次大会亮点颇多:

宣布GPU新核弹B200,超级芯片GB200Blackwell架构新服务器,一个机柜顶一个超算推出AI推理微服务NIM,要做世界AI的入口新光刻技术cuLitho进驻台积电,改进产能。

……

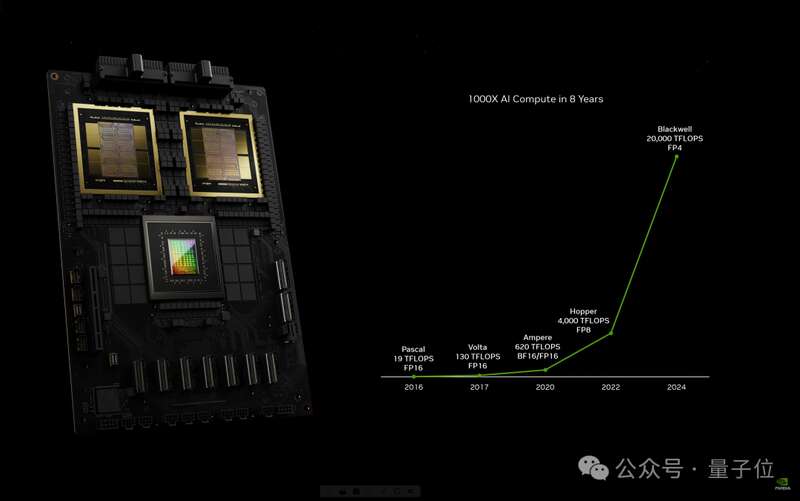

8年时间,AI算力已增长1000倍。

老黄断言“加速计算到达了临界点,通用计算已经过时了”。

我们需要另一种方式来进行计算,这样我们才能够继续扩展,这样我们才能够继续降低计算成本,这样我们才能够继续进行越来越多的计算。

老黄这次主题演讲题目为《见证AI的变革时刻》,但不得不说,英伟达才是最大的变革本革。

GPU的形态已彻底改变我们需要更大的GPU,如果不能更大,就把更多GPU组合在一起,变成更大的虚拟GPU。

Blackwell新架构硬件产品线都围绕这一句话展开。

通过芯片,与芯片间的连接技术,一步步构建出大型AI超算集群。

4nm制程达到瓶颈,就把两个芯片合在一起,以10TB每秒的满血带宽互联,组成B200 GPU,总计包含2080亿晶体管。

没错,B100型号被跳过了,直接发布的首个GPU就是B200。

两个B200 GPU与Grace CPU结合就成为GB200超级芯片,通过900GB/s的超低功耗NVLink芯片间互连技术连接在一起。

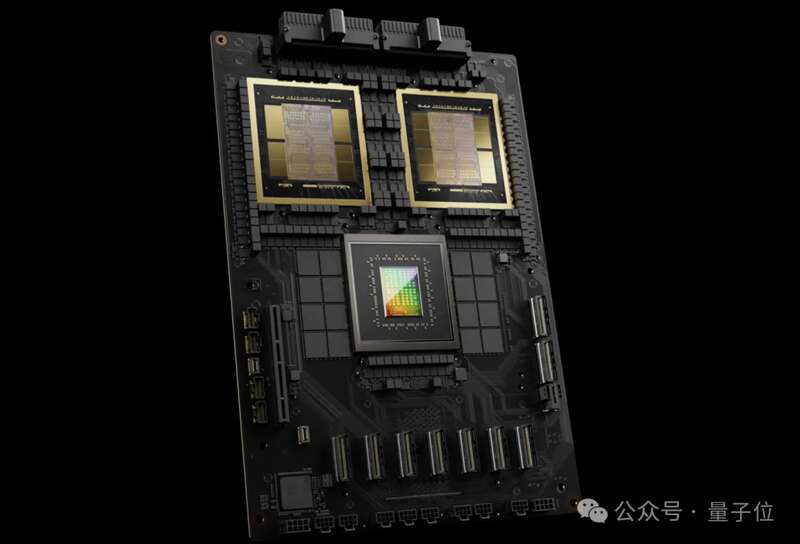

两个超级芯片装到主板上,成为一个Blackwell计算节点。

18个这样的计算节点共有36CPU+72GPU,组成更大的“虚拟GPU”。

它们之间由今天宣布的NVIDIA Quantum-X800 InfiniBand和Spectrum™-X800以太网平台连接,可提供速度高达800Gb/s的网络。

在NVLink Switch支持下,最终成为“新一代计算单元”GB200 NVL72。

一个像这样的“计算单元”机柜,FP8精度的训练算力就高达720PFlops,直逼H100时代一个DGX SuperPod超级计算机集群(1000 PFlops)。

与相同数量的72个H100相比,GB200 NVL72对于大模型推理性能提升高达30倍,成本和能耗降低高达25倍。

把GB200 NVL72当做单个GPU使用,具有1.4EFlops的AI推理算力和30TB高速内存。

再用Quantum InfiniBand交换机连接,配合散热系统组成新一代DGX SuperPod集群。

DGX GB200 SuperPod采用新型高效液冷机架规模架构,标准配置可在FP4精度下提供11.5 Exaflops算力和240TB高速内存。

此外还支持增加额外的机架扩展性能。

最终成为包含32000 GPU的分布式超算集群。

老黄直言,“英伟达DGX AI超级计算机,就是AI工业革命的工厂”。

将提供无与伦比的规模、可靠性,具有智能管理和全栈弹性,以确保不断的使用。

在演讲中,老黄还特别提到2016年赠送OpenAI的DGX-1,那也是史上第一次8块GPU连在一起组成一个超级计算机。

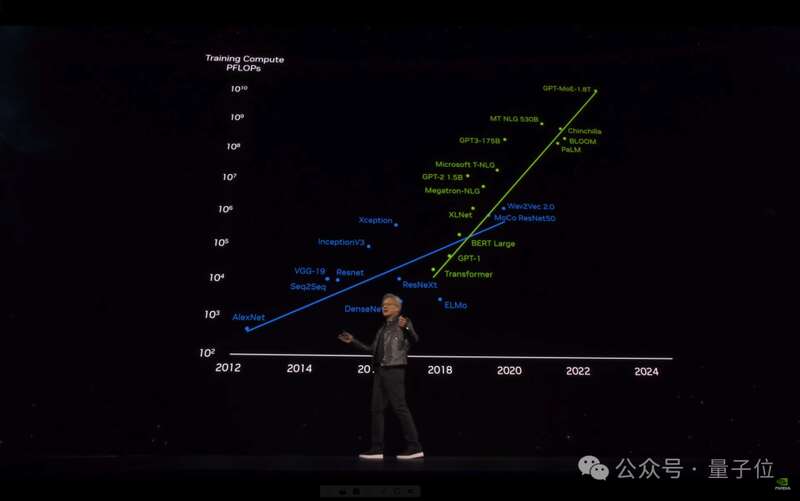

从此之后便开启了训练最大模型所需算力每6个月翻一倍的增长之路。

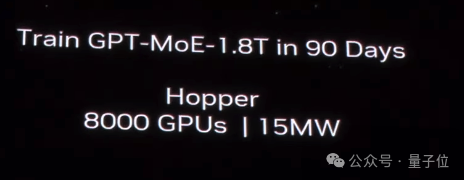

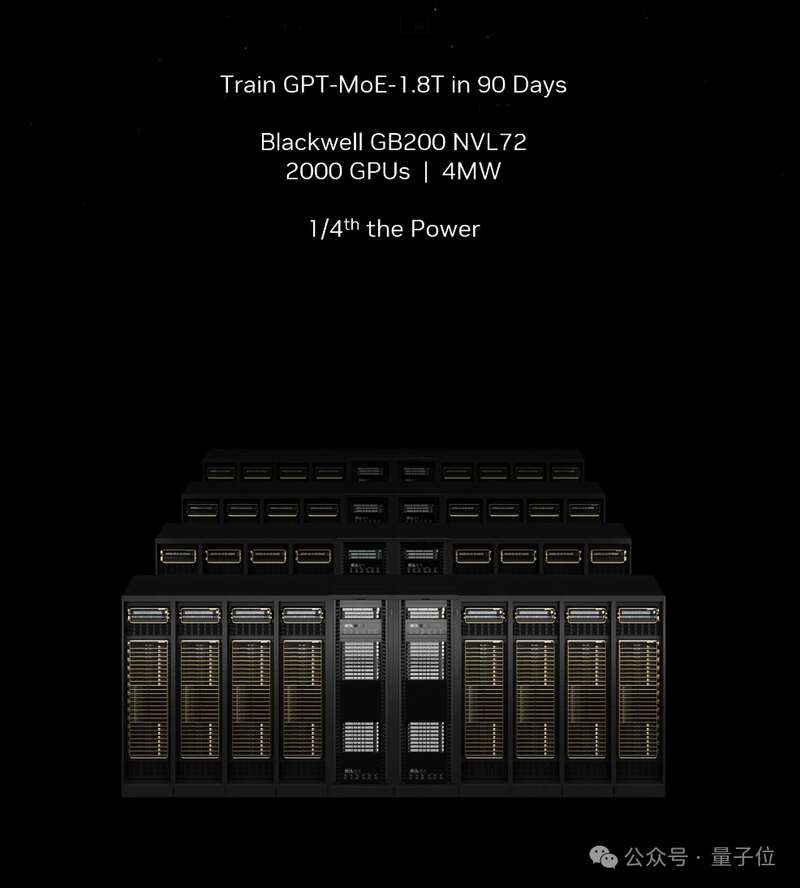

GPU新核弹GB200过去,在90天内训练一个1.8万亿参数的MoE架构GPT模型,需要8000个Hopper架构GPU,15兆瓦功率。

如今,同样给90天时间,在Blackwell架构下只需要2000个GPU,以及1/4的能源消耗。

在标准的1750亿参数GPT-3基准测试中,GB200的性能是H100的7倍,提供的训练算力是H100的4倍。

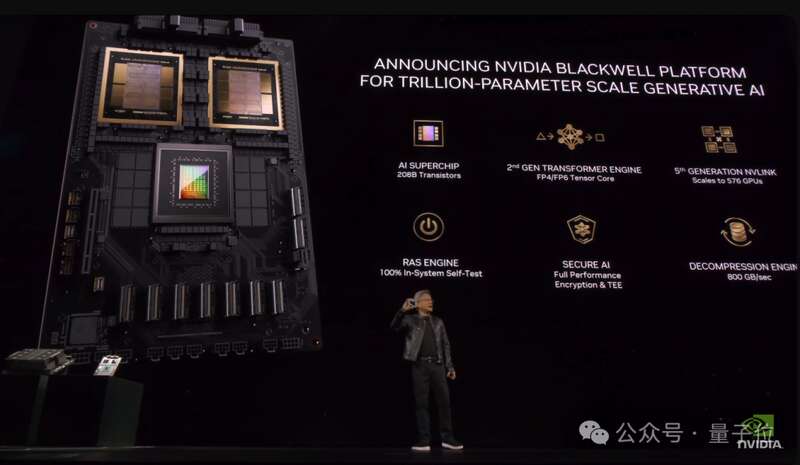

Blackwell架构除了芯片本身外,还包含多项重大革新:

第二代Transformer引擎动态为神经网络中的每个神经元启用FP6和FP4精度支持。

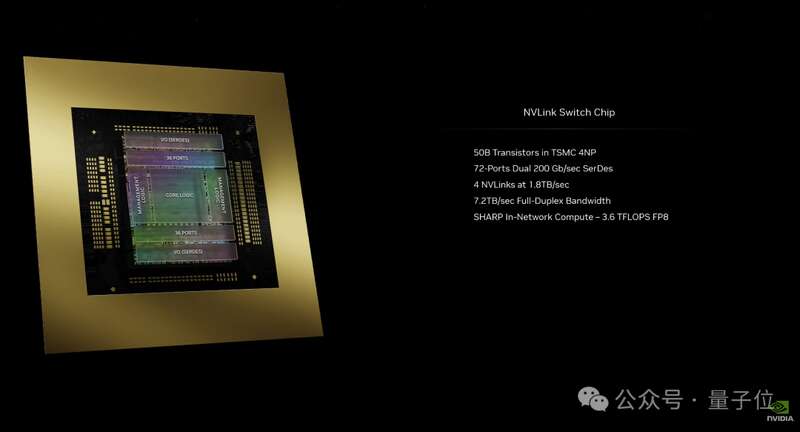

第五代NVLink高速互联为每个GPU 提供了1.8TB/s双向吞吐量,确保多达576个GPU之间的无缝高速通信。

Ras Engine(可靠性、可用性和可维护性引擎)基于AI的预防性维护来运行诊断和预测可靠性问题。

Secure AI先进的加密计算功能,在不影响性能的情况下保护AI模型和客户数据,对于医疗保健和金融服务等隐私敏感行业至关重要。

专用解压缩引擎支持最新格式,加速数据库查询,以提供数据分析和数据科学的最高性能。

在这些技术支持下,一个GB200 NVL72就最高支持27万亿参数的模型。

而GPT-4根据泄露数据,也不过只有1.7万亿参数。

英伟达要做世界AI的入口老黄官宣ai.nvidia.com页面,要做世界AI的入口。

任何人都可以通过易于使用的用户界面体验各种AI模型和应用。

同时,企业使用这些服务在自己的平台上创建和部署自定义应用,同时保留对其知识产权的完全所有权和控制权。

这上面的应用都由英伟达全新推出的AI推理微服务NIM支持,可对来自英伟达及合作伙伴的数十个AI模型进行优化推理。

此外,英伟达自己的开发套件、软件库和工具包都可以作为NVIDIA CUDA-X™微服务访问,用于检索增强生成 (RAG)、护栏、数据处理、HPC 等。

比如通过这些微服务,可以轻松构建基于大模型和向量数据库的ChatPDF产品,甚至智能体Agent应用。

NIM微服务定价非常直观,“一个GPU一小时一美元”,或年付打五折,一个GPU一年4500美元。

从此,英伟达NIM和CUDA做为中间枢纽,连接了百万开发者与上亿GPU芯片。

什么概念?

老黄晒出AI界“最强朋友圈”,包括亚马逊、迪士尼、三星等大型企业,都已成为英伟达合作伙伴。

最后总结一下,与往年相比英伟达2024年战略更聚焦AI,而且产品更有针对性。

比如第五代NVLink还特意为MoE架构大模型优化通讯瓶颈。

新的芯片和软件服务,都在不断的强调推理算力,要进一步打开AI应用部署市场。

当然作为算力之王,AI并不是英伟达的全部。

这次大会上,还特别宣布了与苹果在Vision Pro方面的合作,让开发者在工业元宇宙里搞空间计算。

此前推出的新光刻技术cuLitho软件库也有了新进展,被台积电和新思科技采用,把触手伸向更上游的芯片制造商。

当然也少不了生物医疗、工业元宇宙、机器人汽车的新成果。

以及布局下一轮计算变革的前沿领域,英伟达推出云量子计算机模拟微服务,让全球科学家都能充分利用量子计算的力量,将自己的想法变成现。

One More Thing

去年GTC大会上,老黄与OpenAI首席科学家Ilya Sutskever的炉边对谈,仍为人津津乐道。

当时世界还没完全从ChatGPT的震撼中清醒过来,OpenAI是整个行业绝对的主角。

如今Ilya不知踪影,OpenAI的市场统治力也开始松动。在这个节骨眼上,有资格与老黄对谈的人换成了8位——

Transformer八子,开山论文《Attention is all you need》的八位作者。

他们陆陆续续已经悉数离开谷歌,其中7位投身AI创业,有模型层也有应用层,有toB也有toC。

这八位传奇人物既象征着大模型技术真正的起源,又代表着现在百花齐放的AI产业图景。在这样的格局中,OpenAI不过是其中一位玩家。

而就在两天后,老黄将把他们聚齐,在自己的主场。

要论在整个AI界的影响力、号召力,在这一刻,无论是“钢铁侠”马斯克还是“奥特曼”Sam Altman,恐怕都比不过眼前这位“皮衣客”黄仁勋。

……

直播回放:

https://

算力增长千倍,英伟达为华尔街再续一命

时隔5年,英伟达GTC大会再次恢复线下举行。随着各类Al大模型的推出及落地应用的加速,GTC已经被业界看成“AI风向标”,英伟达创始人兼CEO黄仁勋的主题演讲、市场对各类新品的预期都会影响美股AI概念股股价的走势。

黄仁勋在2024年GTC大会演讲主题为《见证AI的变革时刻》,其提到亮点包括新的架构Blackwell、新的硬件产品GB200及人型机器人项目等最新突破性成果。

整体而言,英伟达发布的基于Blackwell架构的B200芯片浮点运算能力是H100的5倍,这意味着科技巨头采购相同计算能力所需的芯片数量会减少。

在目前大部分AI大模型落地前景尚不明朗的情况下,B200芯片的出现能大幅提升AGI创业公司的算力,加速AGI通用人工智能进程,同时降低算力运行中的能耗成本。

黄仁勋:英伟达要成为AI软件的“晶圆厂”

过去一年,受AIGC热潮的影响,英伟达的总市值翻了4倍多。英伟达股价大涨的催化剂是Open AI于2022年年底推出的ChatGPT。在展示英伟达发展史时,黄仁勋又一次提到其将首台DGX-1送给OpenAI的故事。

2016年4月,英伟达在硅谷发布深度学习超级计算机DGX-1,搭载了8块P100 GPU。尽管当时DGX-1已经收到了近100家公司的订单,黄仁勋却把第一台捐给了OpenAI,这极大缩短了OpenAI训练对话和生成式模型的周期。

“随着transformer模型被发明,我们能以惊人的速度扩展大型语言模型,每六个月就能翻一番。而为了训练这些越来越大的模型,我们也需要更强的算力。”黄仁勋说。

紧接着黄仁勋亮出了新一代芯片解决方案Blackwell及首款基于Blackwell的AI加速卡GB200。

黄仁勋现场将Blackwell架构和Grace Hopper架构的性能进行对比。前一代GPU“Hopper”H100采用4nm工艺,集成晶体管800亿,而同样采用台积电 4NP 工艺的Blackwell 拥有 2080 亿个晶体管。

一般而言,在同一制程及类似的微架构下,晶体管的数量越多,其处理复杂逻辑和并行计算的能力越强。这意味着Blackwell架构的计算和推理能力比上一代更强。

此外,基于Blackwell的处理器,B200AI性能为每秒20千万亿次浮点运算,而此前最强的H100为每秒4千万亿次浮点运算,约是其5倍。

AI芯片的浮点运算能力越强意味着其在处理涉及大量浮点计算的任务(例如科学计算、机器学习、图形渲染等)时效率更高,这不仅可以节省训练的时间成本,也能节省电力等能耗成本。

“如果要训练一个1.8万亿参数量的GPT模型,需要8000张Hopper GPU,消耗15兆瓦的电力,连续跑上90天。但如果使用Blackwell GPU,只需要2000张,同样跑90天只要消耗四分之一的电力。当然不只是训练,生成Token的成本也会随之降低。”黄仁勋举例说。

近八年来,AI 算力增长了一千倍

NVIDIA Blackwell架构的生成式AI引擎,以及更快的NVIDIA NVLink互连和增强的安全功能,将数据中心推向了一个新时代。微软Azure、亚马逊AWS、谷歌云、联想等一众科技巨头都是Blackwell架构的首批用户。

此后,黄仁勋宣布新的AI微服务——NIM软件,用于开发和部署企业级生成式AI应用。黄仁勋表示,与现在靠代码开发软件不同,未来可能就要靠一堆NIMs(Nvidia inference micro service),用与AI聊天的形式调动一堆NIMS来完成训练、应用的部署。英伟达的愿景是成为AI软件的“晶圆厂”。

此外,黄仁勋还在现场重点介绍了人型机器人项目——Project GR00T。GR00T是一个通用基础模型,有望改变模拟人形机器人学习方式。GR00T 经过 NVIDIA GPU 加速模拟训练,使人形机器人能够通过模仿和观察人类动作来进行强化学习。GR00T模型将多模态指令和过去的交互作为输入,并生成机器人执行的动作。

据了解,英伟达目前正在构建包括NVIDIA IAI、Omniverse、ISAAC三大平台,三大平台均与机器人产业高度关联。

为AI概念续了一命

受苹果和谷歌合作消息、以及英伟达发布AI新品的影响,美股三大指数集体收涨。截至3月18日美股收盘,纳指涨0.82%。从个股看,7大科技公司股价都不同幅度上涨。其中,特斯拉涨幅6.25%,谷歌-A涨幅4.6%,微软涨幅0.22%,meta涨幅2.66%,亚马逊涨幅0.03%,苹果涨幅0.64%,英伟达涨幅0.7%。

从消息侧看,特斯拉一天涨幅高达6.25%,或与其宣布在欧洲提高Model Y价格相关。近日,特斯拉宣布,将从4月1日起将北美市场的Model Y车型售价“再次上涨1000美元”。这将是特斯拉 Model Y 一个月内在当地的第二次提价。

苹果股价也结束了连续两周的阴跌,昨晚涨幅0.64%,这与谷歌合作、黄仁勋宣布“NVIDIA Omniverse Cloud将可以连接到苹果公司混合头显Vision Pro”相关。

因为AGI芯片投入成本高昂、落地前景不明,美股AI概念近期陷入疲软。

昨夜,英伟达或许再次给曾斥巨资购买H100的科技巨头们”续了一命”。比如,Meta 在 2023 年买了超过15万块 NVIDIA GPU,2024 年 Meta 预计将购买超过35万块英伟达 H100 GPU( 据Omdia数据)。现在,B200的浮点运算能力是H100的5倍,这意味,科技巨头采购相同计算能力所需的芯片数量减少。

当然前期是,B200的价格不会比H100高很多。黄仁勋并没有在现场公布B200的价格,仅表示其将于今年晚些时候上市。

在H100等芯片取得巨大成功后, 英伟达股价从去年开始节节攀升,但这种攀升在最近两周出现动荡。上周五英伟达收盘报878.365美元/股,较高点跌去10%。

而曾斥巨资购买英伟达AI芯片的科技巨头们也开始考略AI服务能带来多少现实收益。

亚马逊首席执行官Andy Jassy曾多次向投资者表示,生成式AI将为亚马逊带来数十亿美元的收益。然而,面对目前的技术实际应用与预期之间的差距,他也坦承,这项技术当前的直接收益“相对较小”。

英伟达代表的AI概念能否持续为美股续命还是未知数。最关键之战,还在于OpenAI、微软、谷歌、Meta等巨头能否早日将算力投入转化为商业收入。