2022年9月的一个早上,家住南京的杜先生莫名收到一条陌生的短信,信息中还附赠了一张照片。

照片上,自己正和一名陌生的妙龄女子赤身裸体躺在床上,举止亲昵。

短信里,对方让杜先生尽快和一个手机号取得联系,过时不候!

收到威胁之后,杜先生心里倒没有那么慌张。

尽管照片上的脸是自己的,但是杜先生十分确信自己没有做过对不起妻子的事情,更不可能把这种事情拍下来。所以杜先生并没有把这件事放在心上。

但是事情还没结束,第二天中午,杜先生再次收到了一封威胁短信。

这次骗子更加嚣张,直言如果不在规定时间内联系,就要把照片曝光出来,让他身败名裂!

最后骗子还强调:“不要心存侥幸!”

杜先生这次有点慌了:虽然自知清白,但是骗子把假艳照随便乱发,多少也会给自己的生活带来不好的影响。

思来想去,杜先生将收到假艳照的事情告诉给了妻子。妻子听到后,并没有大发雷霆,反倒和杜先生一起研究起假艳照。

经过仔细研究,杜先生发现了假艳照露出的马脚:

虽然脸看起来的确是自己,但是假艳照中男主的发量太多了,和自己的发量不符!

没想到发量稀少这个令人头秃的理由,居然成为了鉴定假艳照的关键。确定艳照为假的杜先生决定报警。

警方经调查判断这是一起盗窃公民基本信息后利用AI换脸进行的“精准诈骗”。

如今像这种利用AI换脸技术实施诈骗的案件,并不在少数,甚至已经搬上荧幕。

犯罪题材电视剧《猎罪图鉴》中,主角沈翊的老师许意多就遭遇了AI诈骗,为AI合成的儿子陆续打款,最终被骗得倾家荡产,最终老人选择投江自尽。

在引发全球关注的俄乌冲突中,也出现了一起堪称历史性的“AI诈骗”事件。

在2022年3月的一则视频中,伪造的乌克兰总统泽连斯基呼吁国内人民放下武器。虽然视频分辨率很低,效果不佳,但已经能以假乱真。

而对于宅男们来说,最知名的“AI诈骗”事件,发生在2017年。

这年的12月,Reddit的成人交流社区突然爆红了一个视频,并且在短短数天内传遍了全球成人视频网站。

这倒并不是因为视频的内容有多夸张,而是这位主角长得非常像当年出演《神奇女侠》的演员盖尔·加朵。

很明显,盖尔·加朵本人是不可能去拍摄这样的影片的,那只有一种可能,这个脸是合成上去的。

不过,这部影片传了没几天,Reddit迫于巨大的压力,就将上传这部影片的匿名账户以侵犯他人隐私的理由给封停了。

全球宅男,被AI换脸技术“诈骗”了。

国内也曾出现过AI换脸的风潮。不过,很多时候,看起来人畜无害,甚至有些滑稽搞笑。

比如既可以是雷神,又可以是海王的徐锦江。

世界知名人物齐唱“吗咿呀嘿”的照片“活化”,特朗普唱“洗海带哟”。

这些,都是AI换脸技术的成果。

这项既造成悲剧,又造成喜剧的技术,究竟从何而来?

更重要的是,我们能否约束住这股势力?

提到AI换脸,就不得不提一个技术:“生成对抗网络”(Generative Adversarial Network, 简称GAN)技术。

2014年,在一间酒吧里,美国AI领域专家Ian Goodfellow, 与朋友觥筹交错畅谈生成模型之际,生成对抗网络GAN就诞生了。

正是GAN的出现,才一步步催生出我们如今所熟知的AI换脸技术。

那GAN网络又是如何运作的呢?

这类网络通常由两个AI代理组成:其一负责生成样本数据,叫生成器网络;另一个则负责检测样本是否真实,叫判别器网络。这两个网络,会轮流考验对方。

通俗点理解,可以将生成器网络视为一个想造假币的人,把判别器网络视为警察。

刚开始,是警察考验造假币的人。想造假币的人技术不成熟,随机制造假币,那些明显不像是真货币的样本,被直接判定为假币。而看起来比较像真币的,就保留了下来。

然后就进入造假币的人考验警察的阶段,警察需要不断增加颜色、质地、图案等等多个维度,来鉴别真货币和假货币。等警察轻松鉴别出假币,又进入考验造假币的人环节。如此,循环往复。

二者对抗的次数越多,假币就越接近真币。

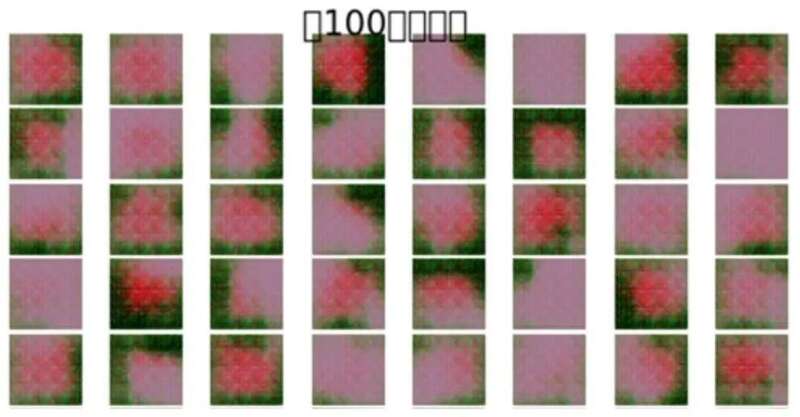

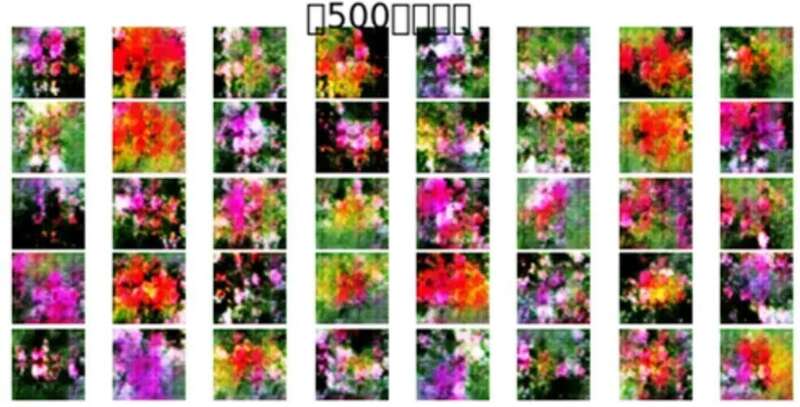

以花卉数据为例。

GAN进行100次生成的对抗PK之后,会出现这样的结果:

500次,会这样:

2000次之后,就能以假乱真了。

经过数千次迭代后,如果一切顺利,生成器网络可以完美生成逼真的虚假图像,并且判别器网络可以很好地判断的图像是真实的还是虚假的。

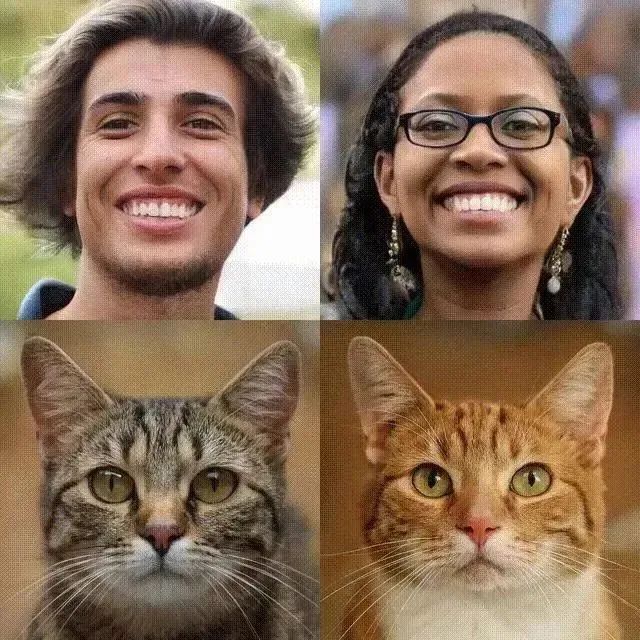

AI换脸就是利用了这一技术。生成对抗的次数越多,就越像是真人。

这种“道高一尺,魔高一丈”的AI深度学习方式很快就受到了很多从业者的关注,GAN最厉害的地方在于,它的深度学习是无监督的。GAN不需要标记数据和记录数据。GAN只有生成,判别,再生成,再判别,不断优化数据。

从GAN诞生之初,他的对抗网络技术就一直不断革新。2015年,研究人员开始将 GAN 与经过图像识别优化的多层卷积神经网络(CNN)相结合。

和普通神经网络相比,卷积神经网络可以激活样本的第三个维度:深度。

可以简单理解为,卷积神经网络可以模仿人眼立体视觉机制对图像进行感知,有立体感。

GAN与CNN这一组合取代了以往较为简单的 GAN 代理驱动网络,也让生成结果的可信度迈上新的台阶。

2016年,有人将GAN与CNN两个网络技术打通,不同网络的代理之间能够相互共享信息。通过这种方式,双方就能开展并行学习。

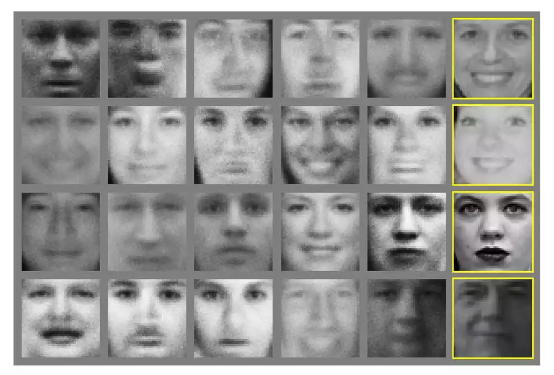

这时候,生成的人脸已经更加可信,但生成的图片“一眼假”的情况仍然没有消失。

主要原因是,由于图像分辨率越低、鉴别器就越难判断内容的真伪,所以生成代理往往倾向于产出模糊不清的图像——毕竟越清晰、越容易出错。

可以理解为AI在摸鱼。

到了2017年,全球可编程图形处理技术头部企业英伟达表示:那我们分阶段训练网络。先由生成AI 学习创建低分辨率图像。之后,将分辨率逐渐提升。

这种方式逐渐培养出的 GAN 开始产出质量空前的伪造人像。虽然图像仍有缺陷,但不仔细观察已经很难快速分辨。

这边英伟达还在继续改进自己的 GAN技术,在另一边,一个Reddit 用户“deepfakes”以一种意想不到的方式,开始将这项技术推向大众视野。

2017年12月,AI换脸的“神奇女侠”在成人交流社区Reddit突然爆红之后。

Reddit迫于巨大的压力,就将上传这部影片的匿名账户“DeepFakes”以侵犯他人隐私的理由给封停了。

但是“DeepFakes”对于封禁极为不满,结果“DeepFakes”将制作这部片子的软件源代码,以免费公开的形式发布在了GitHub上,意图十分明显:

“你封我可以,我把技术公开出来,之后换脸视频遍地开花,看你们怎么封?!”

这就像是潘多拉的魔盒被打开了一样,此后,deepfake一词就成了AI生成图像和视频的代名词。这里的“deep”是指深度学习的方式进行图像生成。

虽然Deepfake 色情视频同样存在严重的“一眼假”问题,但由于制作成本极低,于是成千上万用户迅速涌向 Reddit等在线平台,观看这些露骨又略显诡异的视频。

美国著名女演员斯嘉丽·约翰逊就成为 AI 色情片中的常客,后来人们将这股互联网风潮称为“黑暗虫洞”。

但是deepfake 色情片的好日子也并不长久。2018 年第一季度,Pornhub、Twitter、Gfycat 和 Reddit 等平台纷纷对这类视频下达合成视频封杀令。

同样是在2018年,Deep Video Portrait 软件则尝试利用GAN改进视频处理能力,于是首个研究 deepfakes 的 YouTube 频道正式上线:

这次的影片就不是伪造色情片了,而是一些恶搞影片,包括政治名人或好莱坞大牌的“魔改”版本逐一亮相,包括美国总统。

时间来到了2019年,三星公布了一种能够深度伪造人类和艺术品的 GAN。例如,研究人员成功将蒙娜丽莎的微笑修改成了“大笑版”、“不笑版”。

就在几个月之后,以色列研究人员又推出了换脸 GAN(FSGAN)。这套 AI 模型能够对即时视频中的人脸进行实时交换。无需任何预先训练,这款新 AI 已经能够直接交换人脸,不过在质量上仍然无法与精心训练而成的 deepfakes 模型相比肩。

时间到了2020年,微软推出的 FaceShifter 甚至能够利用模糊的原始图片,生成高度可信的 deepfake 图像。

FaceShifter 同样依赖于两套网络,其一负责创建伪造人脸,并将原始照片内的头部姿势、面部表情、照明条件、颜色、背景及其他属性引入假图像。另一套网络 HEAR-Net 则将前面生成的照片与原始照片进行比对。

如果 HEAR-Net 发现图像中存在头发、太阳镜或文字被脸部遮挡的部分,就会出手修改这些错误。完成后,面部就会正确位于头发、太阳镜或文字内容之后,确保各个元素之间拥有正确的位置关系。

2021年,英伟达和斯坦福大学联合推出的了一个生成图像GAN,刷新了3D GAN的新高度。而且生成画质也更高,视角随便摇晃,面部都没有变形。

这个3D GAN最厉害的地方,莫过于还可给出3D几何数据,这些石像效果,就是根据提取的位置信息再渲染而得到的。

事实上,只用一张单视角2D照片生成3D效果,此前已经有许多模型框架可以实现。但是它们要么需要计算量非常大,要么给出的近似值与真正的3D效果不一致。这就导致生成的效果会出现画质低、变形等问题。

为了解决以上的问题,研究人员提出了一种显隐混合神经网络架构(hybrid explicit-implicit network architecture)。这种方法可以绕过计算上的限制,还能不过分依赖对图像的上采样。

与典型的多层感知机制相比,该方法在速度上可快出7倍,而占用的内存却不到其十六分之一。

该方法使用中等分辨率(128 x 128)进行渲染,再用2D图像空间卷积来提高最终输出的分辨率和图像质量,效果就可以以假乱真了。

就在最近,AI深度学习技术也不只局限于面部生成了。近日,斯坦福大学等团队提出生成人体可编辑辐射场3D感知GAN框架。

首先,他们演示了在包含单视图图像的数据集上以无监督方式训练的GAN生成高质量3D人体。为此,团队采用了基于2D CNN的生成器兼容的3D平面特征表示。

其次,作为GAN训练过程的一环,团队通过引入显式辐射场变形,确保生成器以标准身体姿势合成人的辐射场,然后根据训练数据的身体姿势分布扭曲辐射场,生成的人体就能动了。

实验表明,这种新方法可以生成高质量、可编辑、多视图一致的人体,也就是说,现在可以利用AI除了能生成脸,还能凭空生成完整的、可以像正常人一样灵活运动的身体!

前面提到的,乌克兰总统泽连斯基呼吁国内人民放下武器的视频,除了AI生成面部,还包括部分躯体动作。

在GAN(生成对抗网络)的发明者 Goodfellow 在 2014 年首次展示自己的成果时,肯定想不到自己的成果会推动 AI 伪造图像的快速发展。如今他亲口警告称:在未来,人们将无法再理所当然地相信互联网上传播的图像和视频。

最终,也许再精密的反 deepfake 算法也已经无法识别最新的深度伪造结果,而这必然会给社交、娱乐等各个领域带来颠覆性的改变。

Deepfake 专家 Hao Li 认为这种猜测绝非杞人忧天,毕竟图像的实质不过是辅以适当颜色的像素——AI找到完美的图片方法将只是时间问题。

尾声

现在GAN对抗网络正在被开发出各种各样的应用,其中也有很多对世界正向的积极影响,比如医疗诊断、内容过滤以及安全监控等等,当然,人们如今关注的大多是一些负面的效果,比如侵犯隐私、造假诈骗等等。

并且,近几年,随着AI深度合成技术的不断发展,利用其犯罪的数量也是大幅增加。2021年,山东省公安厅网络安全总队就公布了几个利用深度合成技术实施诈骗的真实案例。

还有的骗子通过盗用了他人社交媒体账号,获取他人面部信息,通过与账号原所有人亲属进行视频电话的形式要求亲友向其指定账号转账,成功地取得了受害人的信任,骗取了大量钱财。

从事件层面来看,利用深度合成技术实施违法犯罪活动是其风险的表象,而从本质上去探究的话,深度合成技术真正危险的是其对社会信任关系的严重破坏。

德国哲学家康德在《实践理性批判》中就曾论证了“无信任社会”的可怕。按照康德的理论,假如谎言是社会的通行法则,那么人人可以说谎。

在“无信任社会”中,信息的真假判断都难以进行,那只能默认一切都为“假”。俗话说,眼见为实,但当眼见、耳闻都不再是真实,谎言和欺骗甚嚣尘上时,社会信任将会荡然无存。

在这种情况等下,作为一个拥有正常理智的人,我们不会再去相信说谎的人,也就不会再相信这世界上的每一个人。

最后,不被相信的谎言也就不再有意义。因为只有在社会信任中,说谎者才能以谎言获利。

在Deepfake这个“潘多拉魔盒”被打开之后,AI的领军人物Yann LeCun也在Twitter上深深反省:

“说真的,要是当初知道卷积神经网络(CNN)会催生Deepfake,我们还要不要发表它?”