图片来源:视觉中国

▎AMD、英特尔和中国公司都在积极开发和发布新的AI芯片产品,以争取在AI芯片市场的份额,与英伟达展开竞争。AMD预计,2027年全球数据中心 AI 计算市场规模将超过1500亿美元。

作者|林志佳

编辑|马金男

本文首发钛媒体APP

随着英伟达率先占领 AI 大模型算力芯片市场,并超过万亿市值。而同时,英特尔、AMD和中国GPU芯片公司也在暗暗较劲,希望在AI算力芯片市场中分一杯羹。

9月19日,美国圣何塞举行的Intel On技术创新大会上,62岁英特尔 CEO 基辛格(Pat Gelsinger)“火力全开”,以俯卧撑开场演讲。

此次会议上,基辛格一口气发布一系列新技术产品:基于Intel 4(5nm)工艺的英特尔酷睿Ultra处理器,代号“Meteor Lake”;预览第五代至强服务器芯片和后续至强产品路线图;披露5nm AI 芯片Gaudi 3等。

英特尔CEO基辛格(Pat Gelsinger)现场做俯卧撑场景

相比往届,此次基辛格“变身皮衣老黄”,全场近2小时大谈 AI 算力对经济的作用。据钛媒体App统计,此次演讲中,基辛格约有200次提到“人工智能”、“深度学习”相关术语。

几乎在同一时间,英特尔、英伟达的竞争对手AMD公司,发布了最新EPYC 8004 CPU(中央处理器)芯片,并预计年底前出货MI300系列AI芯片,以对抗英伟达。此外在国内,包括华为、天数智芯等 AI 芯片厂商也在积极布局大模型训练推理和 AI 算力产品。

“我们与 AI 算力芯片市场领导者英伟达竞争非常激烈。但无论是Gaudi2 还是Gaudi3,都比他们往前迈出了一大步。我们正在获得动力,市场开始意识到,AI 芯片行业领导者中还有另一个机会。”基辛格9月20日对CNBC表示。

市场竞争加剧“老黄”难以独食万亿AI算力

2023年至今,以ChatGPT为代表 AI 大模型“热潮”席卷全球,大模型正推动 AI 向更通用方向发展。

同时,算力的稀缺和昂贵已成为制约 AI 发展的核心因素。而算力也成为了全社会数字化、智能化转型的重要基石,从而带动智能算力需求激增。

据AMD首席执行官苏姿丰(Lisa Su)提供的数据显示,2023年,全球数据中心AI加速器的潜在市场总额将达到300亿美元左右,预计到2027年,这一数字将超过1500亿美元(约合人民币1.095万亿元),年复合增长率超过50%。

英伟达企业运算副总裁曼努维尔·达斯(Manuvir Das)给出了另一组数据显示,预计 AI 所在的潜在市场(TAM)规模将增长至6000亿美元。其中,芯片和系统可分得3000亿美元,生成式AI软件可分得1500亿美元,另外1500亿美元则由英伟达企业软件贡献。

很明显,AI 算力芯片市场是一块大“蛋糕”。

但目前,英伟达却占据全球数据中心 AI 加速市场82%的份额,而且以95%的市场占有率垄断了全球 Al 训练领域的市场,成为这轮 AI 混战中最大赢家。而黄仁勋和他的英伟达公司赚的盆满钵满,市值超越1万亿美元。

与此同时,算力需求的激增,直接导致英伟达GPU(图形处理器)“一卡难求”。而有多少英伟达A100显卡,已经成为衡量一个公司算力的标准。

事实上,一家企业若想研发通用大模型,在算力层面需首先关注两点:显卡数量和价格。

其中,显卡数量方面,OpenAI使用了1万-3万颗英伟达GPU来训练GPT-3.5模型。据集邦咨询最新报告显示,如果以英伟达 A100 显卡的处理能力计算,运行ChatGPT将可能需要使用到3万块英伟达GPU显卡。另外在开源模型方面,Llama模型则是在2048块80GB A100上训练,整个训练算力接近2000 PTOPS算力。

价格方面,目前国内可以买到的H800价格已经高达20万/张,而A100/A800价格已涨至15万、10万/张左右。以2000P算力需求为例,H800 GPU单卡算力2P,需要1000张,预测整个卡价格为2亿元;A800单卡算力约为0.625P,需要数量为3200张,预计整个显卡价格就高达3.2亿元。

除了买GPU显卡,服务器还要考虑整机配置运算,包括CPU、存储、NV-Link通讯连接等,以及电力消耗、场地租金和运维成本等因素。

当下,A800和H800服务器主要以8卡机型为主,为了满足2000 P的算力,就需要配置125台8卡H800服务器,或400台8卡A800服务器,价格分别为3亿元、5.6亿元。而且,由于H800还支持PCIe 5.0、新一代的CPU和内存等,因此需要提升价格,才能发挥其最优的算力性能。

所以,从大模型训练角度看,购买H800的总成本要低于A800,性价比更高,而且也比搭建CPU的成本要低——这也就是英伟达CEO黄仁勋最近常说的:“买的越多,省的越多”。

当然,如果你实在买不起也没关系。英伟达还贴心地推出在线租赁服务DGX超级AI计算系统,通过租赁的方式开放给企业,搭配8个H100或者是A100的GPU,每个节点640GB内存,每月租金为37000美元,从而不用自建数据中心购买大量GPU显卡。这类租赁方式毛利率很高,根据一份关于微软“云端算力租赁”服务报告显示,该业务毛利率高达42%,已成为微软新的“现金奶牛”。

那么国内市场,英博数科、商汤AIDC和其他超过11个智算中心/云厂商也有类似的服务,对于大模型来说,整体价格要比自建价格减少20%以上。

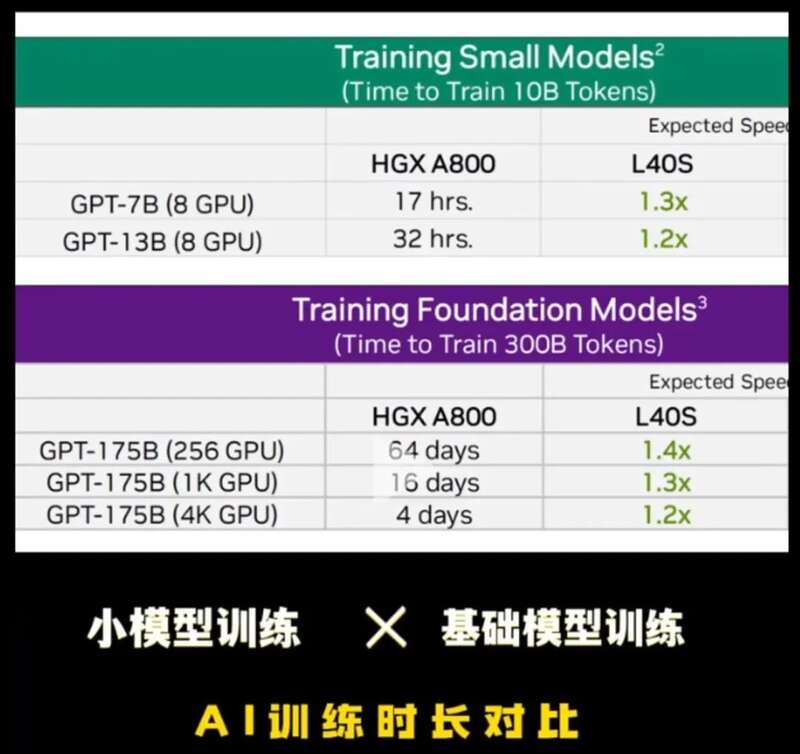

此外还有大模型训练时间。英伟达最新发布的NVIDIA L40S GPU,比A800/H800模型训练效率更高。一个70亿参数的模型,HGX A800跑完需要17个小时,而L40S速度要快1.3倍,短短半天时间就跑完了,更不用说一个1750亿参数的模型,用L40S一个周末时间就能训练完。

总的来说,一家企业要做大模型,需要在算力成本方面就要耗资数亿元,而这才只是“入场券”。

早前有消息称,百度、字节跳动、腾讯和阿里巴巴已经向英伟达下单订购价值50亿美元的芯片,加上此前的囤积的显卡数量,国内拥有英伟达GPU显卡总额超过千亿元。市场调研机构Counterpoint发布报告称,尽管半导体行业周期性下行未止,但腾讯、百度等中国企业仍在大举采购英伟达A800芯片。

那么,这么一个万亿级规模的重要市场,无论是芯片企业,还是下游客户,都不想看到“英伟达”一家独占鳌头。因此,AMD、英特尔和中国GPU芯片企业纷纷试图挑战英伟达在 AI 芯片市场的霸主地位。

AMD首先出击。

AI 芯片方面,今年1月2023年消费电子展(CES)上,AMD董事长、CEO苏姿丰(Lisa Su)正式发布下一代面向数据中心的APU(加速处理器)产品Instinct MI300,采用台积电5nm+6nm结合的Chiplet架构设计,集成CPU和GPU,拥有13颗小芯片,晶体管数量高达1460亿个,AI性能和每瓦性能是前代MI250的8倍和5倍(使用稀疏性FP8基准测试),将在2023年下半年量产供货。

随后6月,AMD还公布全新专为生成式 AI 打造、拥有1530亿个晶体管的 AI 加速芯片Instinct MI300X、Instinct MI300A等产品,在存储容量、互联带宽方面均有提升,MI300X的晶体管数量比H100多两倍,HBM3高带宽内存是H100的2.4倍。单颗芯片上可以运行800亿参数的大模型,预计今年底之前发货。

这不仅全面展示收购赛灵思之后的数据中心 AI 技术能力,而且也在挑战英伟达 AI 算力芯片霸主地位。

当然不止是GPU和 AI 芯片,AMD最擅长的就是做CPU(中央处理器)芯片,毕竟数据中心需要CPU的通用计算能力。去年11月,AMD发布了采用Zen 4架构的第四代数据中心EPYC 9004系列,代号为“热那亚”(Genoa),不仅架构升级,苏姿丰还在这颗芯片上堆料堆到了极致:台积电5nm制程,96个核心,192个线程,384M三级缓存,支持PCle5.0。

与英特尔的八核处理器相比,AMD的数据中心、边缘计算CPU系列在能耗、性能方面都有很大提升,包括热那亚芯片面积减少40%,同时能源效率提高48%。

今年9月,AMD则推出最新第四代EPYC 8004系列,将“Zen 4c”核心引入专用CPU,提供从智能边缘(例如零售、制造和电信)到数据中心、云计算等领域。

事实上,亚马逊云AWS发布了基于热那亚M7A通用计算实例,最终结果显示,性能相比前一代提升50%,而相比英特尔第四代至强白金版8490H版,热那亚在多个应用场景的性能提升达1.7-1.9倍,整体的能效提升达1.8倍,全面用于金融建模、天气模拟、药物研发等高性能计算领域。另外在 IoT Edge网关工作负载中,最新八核EPYC 8024P供电的服务器也为每8kW机架提供大约1.8倍的总吞吐量性能。

整体来看,无论是CPU、GPU,还是FPGA、DPU数据中心处理器,或是软件栈工具AMD ROCm系统,AMD都已经做好了准备,正“磨刀霍霍”以挑战英伟达的产品。

作为成立60多年的芯片巨头,英特尔也不想将市场“拱手让人”。

今年7月11日,芯片巨头英特尔公司(Intel)在北京发布面向中国市场、采用7nm工艺的 AI 芯片Habana Gaudi2,可运行大语言模型,加速AI训练及推理,运行ResNet-50的每瓦性能约是英伟达A100的2倍,性价比相较于AWS云中基于英伟达的解决方案高出40%,并预计今年9月性价比超越英伟达最新H100。

英特尔执行副总裁Sandra Rivera 今年7月对钛媒体App表示,不可能有唯一一家企业独霸 AI 芯片市场。因为市场需要多样性,并且客户也希望看到更多的芯片企业在 AI 领域发挥领导作用。

英特尔CEO基辛格(Pat Gelsinger)

9月,在美国圣何塞举办的英特尔On技术创新大会上,基辛格宣布采用5nm制程的 AI 芯片Gaudi 3将于明年推出,届时,其算力将会是Gaudi 2的两倍,网络带宽、HBM容量则会是1.5倍。

同时,基辛格还预览第五代英特尔至强可扩展服务器处理器,称下一代至强将拥有288核心,预计将使机架密度提升2.5倍,每瓦性能提高2.4倍。另外,英特尔还发布Sierra Forest、Granite Rapids,与第四代至强相比 AI性能预将提高2到3倍。

阿里云首席技术官周靖人表示,阿里巴巴将第四代英特尔至强处理器用于其生成式 AI 和大语言模型,即“阿里云通义千问大模型”,而英特尔技术大幅缩短了模型响应时间,平均加速可达3倍。

此外,对于 AI 大模型训练来说,比较重要的是软件生态。英特尔宣布与 Arm 公司合作,使其至强产品部署到Arm CPU 上,同时推出AI推理和部署运行工具套件OpenVINO,不仅支持预训练模型,而且只需编写一次即可部署任何可用的关键跨平台支持,已支持Meta的Llama 2模型。

同时,Linux基金会在本周还宣布成立统一加速(UXL)基金会,提供开放标准的加速器编程模型,简化高性能、跨平台应用程序的开发,核心是加速演进英特尔oneAPI计划,创始成员包括 Arm、谷歌云、英特尔、高通、三星等公司——英伟达不在其中。

英特尔公司高级副总裁、英特尔中国区董事长王锐对钛媒体App等表示,英特尔后续将发布拥有288核的处理器。数据中心在未来也会越来越多,英特尔将推出Gaudi3、Falcon Shores等产品,产品矩阵将构成未来加速器与AI计算发展的路线图。

“我们把AI的能力内置到芯片中。根据不同需求,内置AI能力将使用不同算力、不同架构来提供支持。”王锐表示,在数据中心方面,从客户端到边缘端,再到云端,AI已经渗透到各种应用场景;从进行大语言模型训练到进行小规模、普惠语言模型训练,AI的影响力无处不在。

今年8月底基辛格表示,他认为英特尔正迈向达成其宏大的整顿目标,朝着恢复在产业的领先地位前进。而谈及英伟达时,基辛格坦承英伟达布局良好,能抓住支持 AI 软件扩张所需系统的需求,但他说,英特尔很快将开始赢得这些加速器芯片市场的订单。

“他们做得很好,我们都赞扬他们。但我们即将展现实力。”基辛格表示。

英伟达市值蒸发千亿美元,国产芯片能否抓住机遇?

英伟达在2023年的辉煌表现,似乎在近两个月有所减弱。

根据Refinitiv的数据显示,尽管英伟达今年股价上涨约190%,表现十分亮眼,但其在9月的股价表现不佳:自8月31日以来,英伟达股价已下跌超过10%,总市值蒸发了超过1760亿美元。

事实上,英伟达股价下跌因素有很多。

首先,市场对美联储为了抑制通膨而将利率维持在较高水准更长时间的担忧加剧,整个股市承压,标准普尔500指数9月平均下跌0.7%、迄今下跌近4%。

其次,以LIama 2为代表的开源模型陆续发布,更多企业开始直接使用这些模型,仅需要AI推理芯片即可应用,这导致了对算力训练芯片的需求有所减少。

最后,据The Information报道,英伟达一直非常关注一些美国中小型云计算公司的显卡供应情况,在当前“一卡难求”的情况下,英伟达对谷歌、Meta等大公司以及中国企业的后续服务和显卡供应,似乎不再是首要优先,而这直接导致市场对于英伟达产品供应能力的质疑。

当然,瑕不掩瑜,英伟达在 AI 算力市场有很大的先发优势。除了GPU芯片性能领先外,其庞大的 AI 软件生态CUDA让很多人望尘莫及。另外,英伟达的NVLink 高速GPU 互连技术也成为大模型技术提升的“关键法宝”,它的作用远高于GPU单卡本身。

百川智能创始人、CEO王小川曾提到,在该行业中,GPU的算力成本大概占40%-70%,而其中网络连接成本和GPU显卡成本的比例大概为3:1。

“未来如果往更高模型去发展,算力储备非常关键。从训练、推理两部分看,推理需要有国产 AI 芯片,而不止有英伟达,但训练目前只有英伟达做的最好。这场‘算力仗’,中国的国产 AI 芯片必须要能顶上。”王小川表示。

实际上,除了两大芯片巨头之外,随着国内“百模大战”,AI 算力需求激增,但英伟达 AI00/H100等多款 AI 芯片限制向中国出口,国内企业越来越难拿到美国的高端芯片。

2022年10月,美国商务部下属工业和安全局(BIS)发布出口管制新规,量化各项芯片算力、带宽、制程等指标,限制美国企业对中国出口,其中关于高算力芯片的限制,直接冲击中国AI、超算、数据中心等相关行业发展。主要满足AI等需求的GPU(图形处理器)厂商英伟达,8月就接到了美国政府限制有关先进芯片出口的通知。

英伟达反应迅速,2022年三季度就投产了A800芯片,以替代无法继续向中国出货的A100。这也是美国公司为此推出的首个“特供”产品。

英伟达并未对外公布关于A800的详细参数,不过,其经销商提供的产品手册显示,A800峰值算力与被限制出口的A100一致,但传输速率被限制在A100的三分之二,以符合美国政府的相关要求。而最新的“中国特供版”H800的训练算力则比H100要差约40%,如果没有英伟达提供的互连模块,算力差距可达60%以上。

英特尔则于2023年7月为其Gaudi 2产品推出中国版本。Gaudi 2是一款ASIC(专用集成电路)芯片,主要面向高性能深度学习AI训练。与2022年5月公布的国际版相比,中国版Gaudi 2中集成的以太网端口由24个减少为21个。英特尔当时称,这是一个相对较小的变动,对实际性能表现影响有限。基辛格日前表示,目前公司正在中国销售Gaudi 2中国版,他希望之后一直这样做下去。

所以在国外芯片限制影响下,华为、天数智芯、寒武纪、登临科技等国内 AI 算力公司积极布局,以填补国产 AI 算力空缺。

目前,国产 AI 算力市场主要分为三大派别:一是华为鲲鹏和昇腾 AI 生态的算力方案,其中没有英伟达GPU的参与;二是混合型算力支持,大量采用英伟达A100芯片,并在部分环境中加入AMD、英特尔以及天数智芯、寒武纪、海光等芯片,以支持大模型的训练;三是租用性价比更高的服务器云算力,以补充算力不足情况。

今年8月举行的2023 亚布力中国企业家论坛第十九届夏季高峰会上,科大讯飞创始人、董事长刘庆峰表示,华为的GPU技术能力现在已经与英伟达A100相当,现在已经做到对标英伟达A100。

9月20日,华为副董事长、轮值董事长、CFO孟晚舟表示,华为推出全新架构的昇腾AI计算集群,可支持超万亿参数的大模型训练。华为将持续打造坚实的算力底座。

天数智芯董事长兼CEO盖鲁江透露,目前,多家国内大模型公司已开始使用国产 GPU显卡,且该公司已支持完成70亿参数大模型训练工作。

另外,其他国产GPU企业多数正处于AI推理训练阶段。

盖鲁江认为,在国内,英伟达在训练领域的市场份额高达95%以上,部分达到99%,基本实现了垄断,这主要得益于其硬件架构和广泛应用的CUDA生态——已有超过300万全球用户。当前,国内GPU企业面临生态迁移难题,由于众多基于CUDA的代码,转向新生态将需大量时间和成本。

在最近一场圆桌活动上,登临科技联合创始人兼首席架构师王平提到,对于AIGC的客户来说,不仅需要文本生成图片等解决方案,更重要的是实用的产品。因此,需要具有大算力和通用性强的算力产品落地应用,为客户创造价值。据悉,登临科技的新一代AI芯片产品能耗比国际主流通用GPU产品有3倍以上的优势。

盖鲁江表示,对于天数智芯来说,下一步计划优化产品迭代,需依赖数据、客户反馈与技术创新,并针对国内特殊需求进行调整。同时,公司会积极完善生态体系和软件栈,确保用户在效率、成本、性能和性价比上获得最优体验,以推动产品进一步商业化。

王平认为,由于获取美国高端芯片的难度增加,虽然国内尚无企业能生产能真正替代的芯片,但他相信国产算力会不断增长。芯片需不断迭代,用户越多,问题反馈越多,国产 AI 芯片企业才能在后续迭代中改进,提升使用体验。

“对国内通用GPU企业来讲,这是一个重大的机遇。”盖鲁江告诉钛媒体App。