OpenAI可能遇到了成立以来最大的公关危机!而Sam Altman的应对速度之快,效果之好,绝对值得所有公司老板和公关人逐帧学习。

我们先看OpenAI最新的动作——官推5月28日突然宣布:

图源:X

OpenAI董事会成立安全与安保委员会(Safety and Security Committee),将就OpenAI项目和运营的关键安全决策,向全体董事会提出建议。

同时还高调放出消息:已经开始训练其下一个前沿模型,预计”将在通向AGI的道路上再上一层楼”。

但如果只是看到OpenAI只是在进行日常的AI安全工作推进,顺便秀了一下肌肉,很多吃瓜群众可能会产生疑问——为什么成立安全委员会和新模型开始训练,两个原本完全没有联系的事情,要放在一起来说?

公告的潜台词,到底是什么?

图源:X

安全团队骨干叛逃,前董事会成员发文攻击

事情要从去年OpenAI的宫斗抓马说起,虽然“OpenAI遵义会议”最终确立了以Altman为核心的领导架构,但是公司高层对于AI安全问题的分歧却依旧没有解决。

“AI安全”这条暗线,从2015年马斯克拉人成立OpenAI时起,就已埋下。

最近,负责AI安全的“超级对齐团队”主管Ilya和Leike双双出走,又把OpenAI管理层架在火上烤了。

图源:X

而Leike转头就加入了“OpenAI复仇者联盟”——和OpenAI团队价值观不同,后来出走的两位前员工联创的Anthropic。

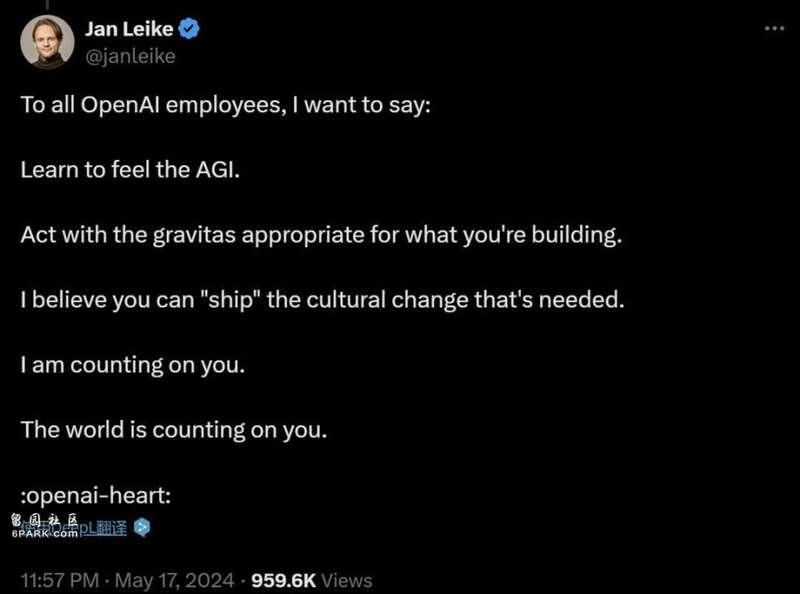

临走时的他,不忘对OpenAI的员工们高呼:

我想对所有OpenAI员工说:

学会感受AGI。

以与你们正在建设的事业相称的威严行事。

我相信你们能够 “推动 “所需的文化变革。

我指望着你们。

全世界都指望着你们。

图源:X

这番言论,就差指着OpenAI管理层的鼻子说——你们不重视AI安全。

据TechCrunch,Leike能向Anthropic首席科学官Jared Kaplan直接汇报,而Anthropic目前正研究可扩展监督的研究人员(以可预测和理想的方式控制大规模人工智能行为的技术)将会向 Leike 汇报。

图源:TechCrunch

Leike和Ilya的出走网友也引得网友纷纷质疑,OpenAI开发AGI到底为了抢走大家饭碗,还是为了全人类的福祉?

图源:X

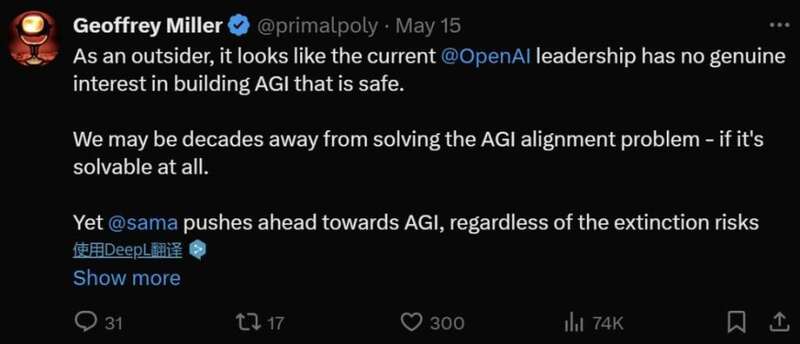

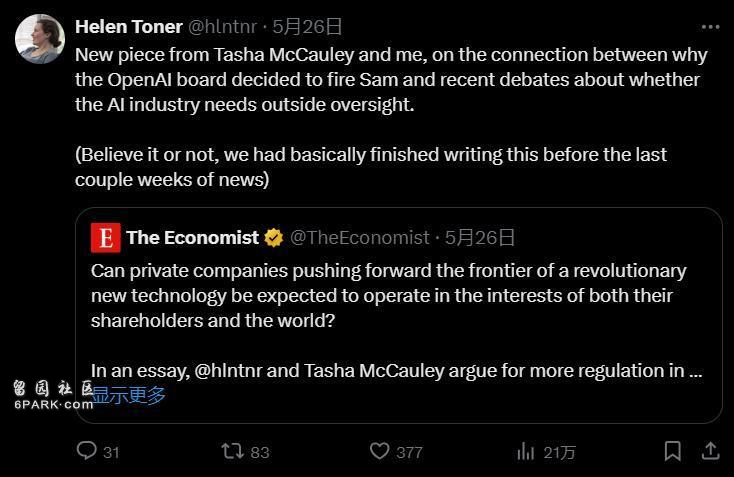

5月26号,OpenAI宫斗剧的始作俑者、前 OpenAI 董事会成员 Hellen Toner 和 Tasha McCauley 都站出来撰文指认Sam Altman以及他治下的OpenAI,完全不把AI安全当会事。

在这两位OpenAI的前董事会成员看来,AI公司内部完全不可能进行有效监管,外部监管势在必行。

图源:X

5月28日,播客The Ted AI Show的最新一期里 Hellen Toner 又透露:堂堂OpenAI董事会成员,居然要通过推特才能知晓ChatGPT发布!

Toner强调,由于OpenAI董事会的非盈利性质,其设立是为了确保OpenAI要将公益而非利润置于首位。但鉴于Altman多次向董事会撒谎,董事会的工作也很难开展了。主持人补刀:OpenAI忘本了。

在这八方讨伐、前后受敌的背景下,我们看看Sam Altman和OpenAI教科书级别的公关组合拳。

一套组合拳,能否让OpenAI转危为机?

第一招,设立全新AI安全机构,补上“叛逃人员”出走带来的组织真空。

28日,OpenAI官宣了这两件事,我们来给大家翻译下。

OpenAI董事会成立安全与安保委员会(Safety and Security Committee),将就 OpenAI 项目和运营的关键安全决策,向全体董事会提出建议。

安全与安保委员会将由董事Bret Taylor(董事会主席)、Adam D’Angelo、Nicole Seligman和 Sam Altman领导。

——我们有一个完整的最高层级的架构,保证OpenAI在追求AGI的过程中会充分考虑AI带来的安全问题。

同时高调放出消息:

我们已经开始训练其下一个前沿模型,预计”将在通向 AGI 的道路上再上一层楼”。

——我们将对公众进一步增加最前沿(危险)模型的透明度,希望大家能相信我们。OpenAI不会背着全世界手搓一个核武器出来的。

公告其余内容:

安全与安保委员会的首要任务是,未来90天内,评估并进一步开发OpenAI的流程和保障措施。90天结束后,安全与安保委员会将与全体董事会分享他们的建议。经过董事会的全面审查后,OpenAI将以符合安全和安保的方式公开分享已采纳建议的最新情况。

——委员会不是摆设,第一步就是要全面评估,OpenAI的开发流程有没有安全问题,90天为限!

OpenAI 技术和政策专家 Aleksander Madry(准备负责人)、Lilian Weng(安全系统负责人)、John Schulman(对齐科学负责人)、Matt Knight(安全负责人)和 Jakub Pachocki(首席科学家)也将出席委员会。

——委员会不都是务虚的领导,核心成员都是技术背景出身,详见下文介绍。虽然Ilya和Leike走了,但是我们OpenAI依然人才济济。

此外,OpenAI将通过保留并咨询其他安全、安保和技术专家以支持安全工作,其中包括前网络安全官员、为OpenAI提供安全建议的Rob Joyce和John Carlin。

——我们也会充分利用外部力量,帮助好AI安全治理。AI安全不仅只有OpenAI的内部监督。

但是网友好像也没那么买账,现在完全不关注GPT是5还是6,但转而嫌弃起新的安全团队:你Altman一手遮天,又能发挥什么作用?

图源:X

“你这么搞就是垂帘听政,大家不会相信你,也不会信任你组的安全团队!”

图源:X

要不说Altman是金牌公关呢,他一定能料想到网友对官方举措不一定买账,两个消息刚刚官宣,创始人IP也要继续立起来!

第二招,捐出一半身家,只为博个好名声。

同样是28日,Altman与其丈夫作为亿万富翁,已宣布加入“捐赠誓言(Giving Pledge)”,将捐赠一半以上个人财产用于改善社会。

图源:官网

在这份落款日期为18日的联合公开信中,二人表示:

如果没有许多人的辛勤工作、才华、慷慨和奉献精神来改善世界,我们就不会做出这样的捐赠承诺。因为正是这些人搭建了社会的脚手架,让我们走到了今天。我们的感激之情无以言表,只能将这份恩情记在心中,尽己所能回报社会,将这一脚手架搭得更高。

我们打算将捐赠重点,放在支持技术上,这些技术有助于为人们创造富裕,以便他们能够将脚手架搭建得更高。

Giving Pledge的发起人巴菲特、盖茨夫妇,名字都是响当当。签署了捐赠誓言,富人就相当于生前或遗嘱中,要将至少一半的财富捐给慈善机构或用于慈善事业。

据彭博社,Altman的身价至少有20亿美元。

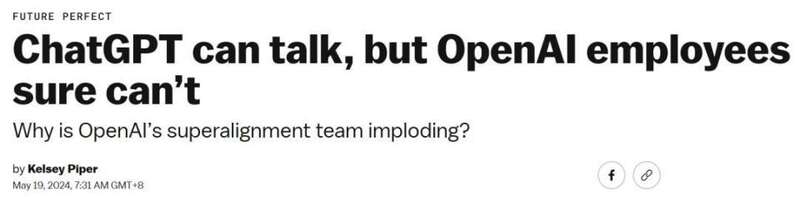

第三招,将一切负面消息扼杀在摇篮中。

在5月中旬,有媒体爆出OpenAI在和员工签署的劳资合同中,明确要求离职员工不能在离职后发表不利于公司形象的言论,否则就会失去兑现自己所持OpenAI“期权”的机会。

图源:Vox

这个“霸王条款”刚被曝出来时,网上一片哗然。可舆论刚要发酵,Altman就公开表态——公司高层完全不知道有这么一条“PR条款”,现在已经将条款删除。

图源:X

高层是否知道合同中这条“PR条款”,已经无从考证。但如果“PR条款”就是公关危机的源头,那最简单的办法就是直接删除它。

这一套组合拳,有事前预防,事中应对,到事后弥补。Sam Altman和OpenAI这教科书一般的危机公关手段,让人不由得拍手叫绝。

但事情发展至此,除了看OpenAI的热闹之外,大家也一定会关心,什么样的配置,才能弥补Ilya和Leike出走带来的安全团队缺口?

技术背景雄厚,看看安委会大佬的实力

安全和安保委员会中的OpenAI 技术和政策专家,都是公司各部门的一把手(Head)。

Aleksander Madry(准备负责人)

公开照片

公告中介绍的OpenAI 技术和政策专家,Aleksander Madry被列在第一个。

个人主页介绍,Madry 是 MIT EECS 系(电气工程与计算机科学系,MIT最大的系)教授,也是CSAIL(MIT的计算科学与人工智能实验室)成员。

在X的主页上,他将自己的工作描述为“让人工智能更加可靠和安全,对社会产生积极影响”。与之呼应的,Madry 也在 MIT 担任可部署机器学习中心(致力于为真实世界部署打造稳定、可靠、安全的AI系统)的主任和人工智能政策论坛联合负责人。

图源:领英

他于 2011 年获 MIT 博士学位。但在加入 MIT 前,他还有过微软新英格兰研究院、洛桑联邦理工学院的研究、工作经历,兼具业内及学界的资深经验。

图源:领英

Lilian Weng(中文名翁荔,安全系统负责人)

公开照片

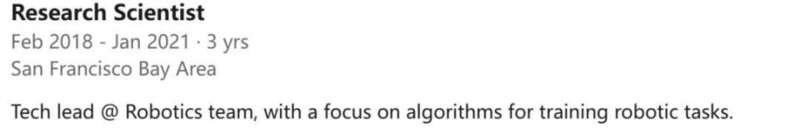

2018 年进入 OpenAI 时,翁荔并非直接负责安全相关的工作,而是担任机器人团队的技术主管,专注于训练机器人任务的算法。但OpenAI后来放弃了机器人的研究。

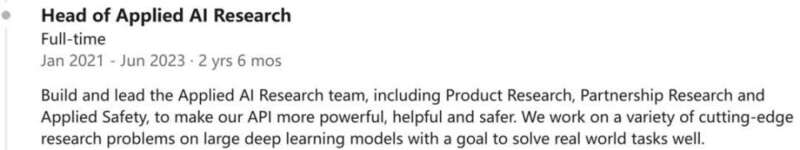

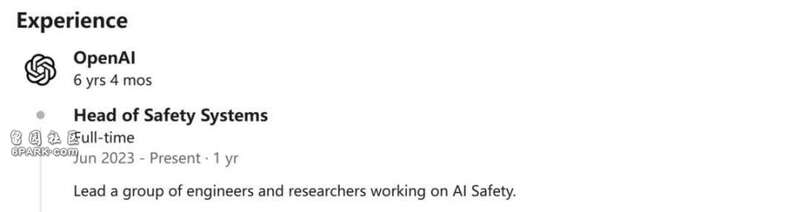

图源:领英

也是在 2021 年,翁荔得工作职责内开始明显涉及安全相关的内容。她在这一年建立、领导应用人工智能研究团队,开始关注安全和对齐问题。

图源:领英

2023 年,她正式开始领导致力于人工智能安全的工程师和研究人员团队。

图源:领英

翁荔本科就读于北京大学信息管理系,后于去了美国印第安纳大学伯明顿分校读计算机,之后有 affirm(金融科技)、Dropbox(云存储服务)等公司的工作经历,也在 Facebook 实习过。

图源:领英

John Schulman(对齐科学负责人)

公开照片

Schulman 是OpenAI 的联合创始人。作为后训练(post-training)团队的领导者之一,负责微调 ChatGPT 和 OpenAI API 中部署的模型。

除此之外,语言模型对齐是他的研究兴趣。他也关注模型的表现行为(behave),致力于提高模型在公众前的透明度。

此前,Schulman 在加州大学伯克利分校获得了计算机科学博士学位,从事机器人技术和强化学习工作。他在伯克利大学短暂学习过神经科学,我在加州理工学院学习物理。

图源:个人主页

Matt Knight(安全负责人)

公开照片

Knight 负责领导 OpenAI 中安全、IT 和隐私相关的工程及研究。

图源:领英

Knight 有达特茅斯学院的工程科学学士学位。

图源:领英

此前,Knight 专门从事安全嵌入式系统的开发工作,兼具软件和硬件方面的专业知识。由于Knight 对射频网络和物理层的特别兴趣,他专门基于盲信号分析(blind signal analysis),对 LoRa PHY 搭建了逆向工程。

Jakub Pachocki(首席科学家)

公开照片

突然提到 Pachocki 可能略显陌生,但他就是 Ilya 走后的接班。

我们不妨再来看看这位技术大佬的履历。

图源:领英

Pachocki 拥有卡内基梅隆大学理论计算机科学博士学位,曾担任OpenAI研究总监领导研发 GPT-4,参与过大规模 RL 和深度学习优化的基础研究。此前公告曾介绍,Pachocki 在将 OpenAI 愿景重新聚焦于扩展深度学习系统方面,发挥过重要作用。

图源:领英