人工智能技术的发展给骗子带来新的诈骗花招,AI语言克隆便是其中之一,在这种诈骗中,骗子通常会用AI克隆你的家人或亲友的声音,向你发出求助,让你信以为真,当你把钱汇出去时,才恍然发现原来是骗局。

根据CBS2NY报道,美国联邦贸易委员会的数据显示,过去四年,涉及商业冒名顶替者的诈骗不断增加。去年,损失超过 7.52亿美元。

CBS2NY进行了调查,发现克隆某人的声音非常容易。

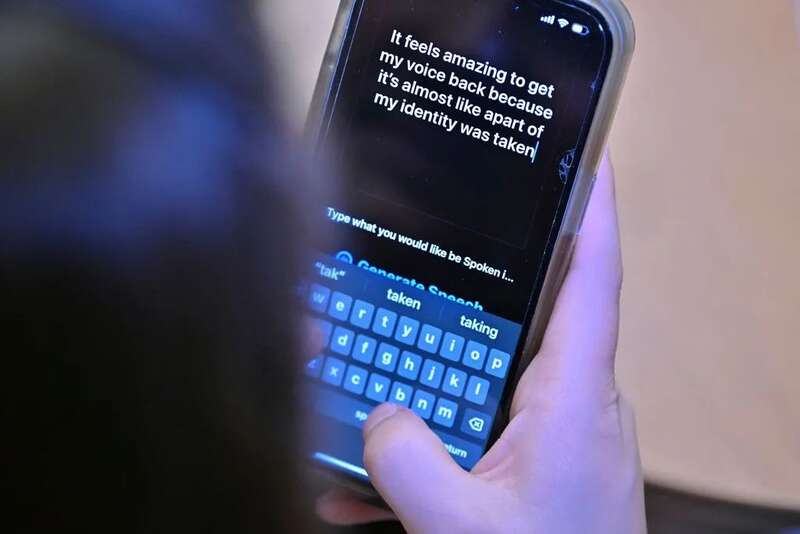

AI语音技术是一把双刃剑,它可以帮助失去声音的人发声,也会被利用来行骗。图为一名失去声音的女孩输入文字,AI用她的声音说出。(美联社图)

由人工智能支持的网站允许任何人克隆亲人的声音,步骤简单快捷。用 Google搜索,很快就可以找到一个人工智能网站,仅需支付五美元,就可以使用其语音克隆服务。

接下来只需要某人一段 30秒的音频片段,然后输入你想说的话,AI便能克隆出这个人的语音。整个过程只需二到四分钟。

骗子可以从发布到社交媒体的视频,或从语音邮件中提取你的声音,或者他们可以给你打电话并录音,让你防不胜防。

AI语音克隆是如此逼真,甚至连经验丰富的人也可能受骗上当。

据CBS2NY报道,加里·希尔霍恩 (Gary Schildhorn)是一位律师,他本人也差点成为声音克隆骗局的受害者。

某天他接到儿子的来电,说“爸爸,我遇到麻烦了,我出了事故。我想我鼻子骨折了。我撞到了一名孕妇。他们逮捕了我,我进了监狱。快帮帮我”

希尔霍恩说,他真的以为就是儿子,因为那就是他的声音。“我知道那是我的儿子。我心里毫无疑问。”

他赶紧开车去银行提取 9000美元现金,同时向儿子的妻子通报了最新情况。然后他接到儿子通过 FaceTime打来的电话。儿子说,“爸爸,我很好。你被骗了。”

由于他没有损失金钱,所以没有法律追索权。

希尔霍恩联系了执法部门,但被告知犯罪分子无法追踪,因为骗子使用一次性手机来获取加密货币。

AI骗局这么厉害,怎么防范呢?

国会众议员伊维特·克拉克(Yvette D.Clarke)代表纽约第九选区,也是美国众议院人工智能工作组的成员。她提出了一项立法,要求公司对人工智能生成的内容添加数字水印。

如果该法案通过,消费者将被警告他们正在听假的语音,如果他们受到假语音内容的伤害,他们可以提起诉讼。

克拉克说:“对于普通人来说,辨别人工智能生成的内容和真实的内容将非常困难……采取防范措施的时间很紧迫。”

一家AI合成音频的初创公司对制定法规表示支持:“非常支持引入监管,这将有助于确定数字内容的起源,包括水印。”

执法部门建议民众,您应该创建一个密码并与家人分享。在紧急情况下,代码将帮助您验证电话上的人是真还是假。

执法人员还表示,如果有人向你索要金钱或敏感信息,请暂停。

皇后区检察官凯兹说:“尊重你的感觉,相信你的直觉,相信你的判断并仔细检查。”

看完骗子的手段只想说,人类科技发展越来越迅猛,但彼此之间也越来越安全,如今我们已经回到了“家人分享秘密”的时代,以后还有什么可以相信呢!