以 GPT-4 为代表的大模型已经建造了大脑,下一步则是需要能承载这一大脑的机器人躯体。

昨天深夜,人形机器人明星公司 Figure AI 震撼发布了一段视频,展示了他们的机器人 Figure 01 在 OpenAI 强大模型的支持下,进行的一系列对话交互。

视频中的机器人展现出了灵活的操作反应,其与人类沟通的流畅度几乎可以与真人相媲美。

这距离 Figure AI 获得 OpenAI、微软、英伟达等公司投资,仅仅过去了不到半个月。也让我看到,OpenAI 最强的多模态大模型有了身体后会是什么样子。

Figure 01,最懂你的人形机器人?

得益于 OpenAI 多模态大模型的强大支持,Figure 01 现在可是个桌上物品识别的小能手。苹果、沥水架、水杯和盘子,对它来说都是小菜一碟!

饿了,想让它整口吃的,它能秒懂你的心思,麻溜地递上一个苹果。

而且,它甚至能在捡起你丢弃的垃圾,边还能跟你解释为啥刚才给了你苹果。在大模型的辅助下,Figure 01 可以理解桌面上唯一的食物——苹果。

在人类的一声令下,Figure 01 还能做家务,收拾餐具,这机器人,简直是家庭生活的最佳伙伴。

广大网友在看到这段令人惊艳的视频后,反应可谓是五花八门。

网友已经迫不及待地给 Figure 01 安排任务了,任务清单里怎么还混进了机器人前辈的电影。

竞争对手怕是要看在眼里,急在心里,准备暗地里摩拳擦掌,来一场技术大比拼?

更兴奋的网友表示,AGI 的曙光似乎就在眼前。

当然,总有些挑剔的声音,有的网友就吐槽说,这机器人说法怎么结结巴巴呢?

网友也没放过玩梗的机会。

Figure AI 掌门人 Brett Adock 也不甘寂寞,在 X 上跳出来做了一番精彩解读。

视频展示了端到端神经网络的应用(end-to-end neural networks)。在此过程中没有使用遥控器(teleop)。视频是以实际速度(1.0 倍速)拍摄的,并且是连续不断的。

如您在视频中看到的,机器人的速度有了显著的提升,我们正在逐步达到与人类相似的速度。

无需遥控,自学成才

那么 Figure 01 是怎么做到的呢?

Figure AI 团队负责人 Corey Lynch 在 X 上解释了一番。

具体来说,视频中展示的所有行为都是通过学习获得的(非遥控操作),并且以实际速度(1.0 倍速)执行。

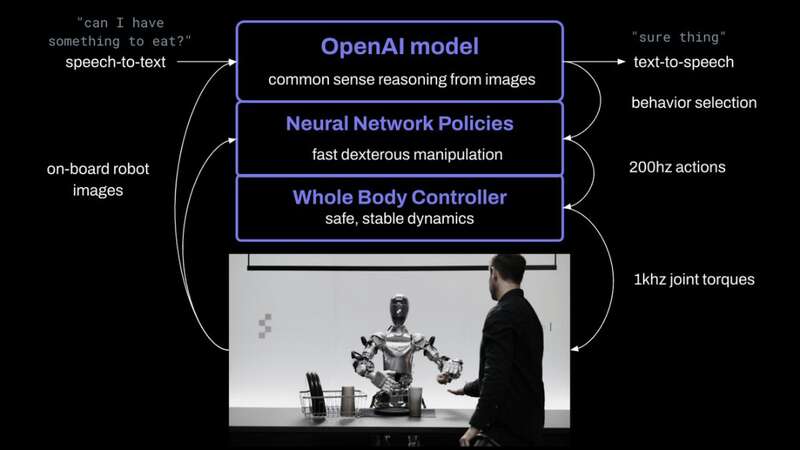

Figure AI 将机器人摄像头拍摄的图像和通过板载麦克风记录的语音转录文本输入到一个由 OpenAI 训练的多模态模型中,这个模型能够同时理解图像和文本信息。

该模型会处理整个对话的历史记录,包括以往的图像,以生成语言响应,并通过文本到语音的方式向人类回话。同一个模型还负责决定执行哪种已学习的闭环行为来响应给定的命令,它将特定的神经网络权重加载到 GPU 上,并执行相应的策略。

而将 Figure 01 连接到一个大型预训练的多模态模型,为其带来了许多有趣的新功能。

现在,Figure 01 + OpenAI 能够:

详述其周围环境。

在决策时运用常识推理。例如,「桌子上的餐具,像那个盘子和杯子,很可能接下来会被放到烘干架上」。

将含糊的高级指令,如「我饿了」,转化为符合情境的适当行为,比如「递给那个人一个苹果』。

用简单的英语解释为什么它执行了某个特定的动作。例如,「这是我能够从桌子上提供的唯一可食用物品」。

当谈到 Figure 01 通过学习掌握的精细双手操作技能时,其实这背后也蕴含着一系列复杂而精妙的原理。

所有行为都由神经网络的视觉-运动转换器策略驱动,这种策略能直接将图像像素映射到动作。这些网络以每秒 10 帧的速率接收机器人内置图像,并生成每秒 200 次的 24 自由度动作(包括腕部姿势和手指关节角度)。

这些动作作为高速「设定点」,供更高速率的全身控制器跟踪,确保动作的精确执行。

这种设计实现了关注点的有效分离:

互联网预训练模型对图像和文本进行常识推理,以生成一个高级计划。

学习到的视觉-运动策略执行这个计划,完成那些难以手动指定的快速、反应性行为,例如在任何位置操纵一个可变形的袋子。

同时,全身控制器负责确保动作的安全性和稳定性,例如,保持机器人的平衡。

对于 Figure 01 取得的巨大进步,Corey Lynch 感慨道:

就在几年前,我还认为与一个能自主规划和执行学习行为的人形机器人进行完整对话,将是未来数十年后的事情。显然,许多事情已经发生了巨大变化。

这会是人形机器人的 GPT 时刻吗

不得不说,Figure 01 的发展速度简直像是踩了油门,一路狂飙。

今年 1 月,Figure 01 就掌握了制作咖啡的技能,这一成就得益于端到端神经网络的引入,使得机器人能够自主学习和纠正错误,仅需 10 小时的训练。

一个月后,Figure 01 已经学会了搬运箱子并运送至传送带的新技能,尽管其速度仅为人类的 16.7%。

在这个过程,Figure AI 商业化的步伐也未曾停歇,与宝马制造公司签订了商业协议,将 AI 和机器人技术融入汽车生产线,并落户于宝马的工厂。

紧接着,就在两周前,Figure 宣布完成了 6.75 亿美元的 B 轮融资,公司估值飙升至 26 亿美元。

投资方几乎涵盖了硅谷的半壁江山——Microsoft、OpenAI 创业基金、英伟达、Jeff Bezos、Parkway Venture Capital、Intel Capital 和 Align Ventures 等。

当时,OpenAI 与 Figure 还宣布将共同开发下一代人形机器人 AI 模型,OpenAI 的多模态模型将扩展到机器人感知、推理和交互环节。

如今,从 Figure 01 身上,我们仿佛能窥见未来生活的草稿。

事实上,在大模型之前,机器人属于专用设备,如今有了大模型的通用能力,通用机器人开始曙光乍现,现在的我们不止需要 ChatGPT,还需要 WorkGPT。

这些进化间接印证了一条清晰可见的道路:当 AI 大模型生根发芽之后,总归是要走进现实世界,而具身智能则是最佳的路径。

一直活跃在 AI 前线的英伟达创始人黄仁勋曾洞察道:「具身智能将引领下一波人工智能浪潮。」

将 OpenAI 大模型融入 Figure 01 也是有意的战略布局。

成熟的 AI 大模型充当人工大脑,模拟了人脑复杂的神经网络,实现了语言理解、视觉识别、情景推理等认知功能,解决了机器人更高层次的认知和决策问题。

与此同时,各种传感器、执行器、计算单元被集成到机器人躯体中,实现了对环境的感知和交互。比如视觉系统可以捕捉图像和视频,触觉传感器可以感受物体的形状和质地等。

Figure AI 创始人 Brett Adcock 此前在接受采访时表示,未来 1-2 年,Figure AI 将专注于开发具有里程碑意义的产品,期望在未来一两年内向公众展示人形机器人的研发成果,涵盖 AI 系统、低级控制等,最终呈现能在日常生活中大展身手的机器人。

他还透露,在成本方面,一个人形机器人约有 1000 个零件,重约 150 磅(68 公斤),而电动汽车可能有约 1 万个零件,重达 4000-5000 磅(1800-2250 公斤)。因此,长期来看,人形机器人的成本有望低于廉价电动汽车,这取决于执行器、电机组件、传感器的成本及计算成本。

机器人专家 Eric Jang 曾提出他的洞见:「尽管许多 AI 研究者认为通用机器人的普及还需数十年,但别忘了,ChatGPT 的诞生仿几乎就在一夜之间。」

一年前的今天,OpenAI 震撼发布了 GPT-4,向世界证明了大模型的强大威力。

一年后的今天,我们没等来 GPT-5,但也迎来 Figure 01,而这会是人形机器人的 GPT-4 时刻吗?

只用13天,OpenAI做出了能听、能说、能自主决策的机器人大模型

资深机器人专家 Eric Jang 不久前曾预言:「ChatGPT 曾在一夜之间出现。我认为,有智慧的机器人技术也将如此。」

他或许说对了。

北京时间 3 月 13 日深夜,一段人形机器人的视频开始在 X 上热传。

之前从未展示过机器人方向能力的 OpenAI,在与投资公司的人形机器人的合作中,第一次展示了自己的机器人智能能力。

Figure,OpenAI 投资的机器人公司,上传了这段视频。在视频中,Figure 的人形机器人,可以完全与人类流畅对话,理解人类的意图,同时还能理解人的自然语言指令进行抓取和放置,并解释自己为什么这么做。

而其背后,就是 OpenAI 为其配置的智能大脑。

在过去一年的具身智能进展中,或许你曾经看过类似的机器人自主决策、拿取物品的展示,但在这段视频中,Figure 人形机器人的对话流畅度、展现出的智能感,接近人类操作速度的动作流畅性,绝对都是第一流的。

Figure 还特意强调,整段视频没有任何加速,也没有任何剪辑,是一镜到底拍摄的。同时,机器人是在完全自主的情况下进行的行为,没有任何远程操纵——似乎在暗暗讽刺前段时间爆火的展现了酷炫机械能力,但是没有太多智能程度的斯坦福炒菜机器人。

比起机器人的智能表现,更可怖的是,这只是 OpenAI 小试牛刀的结果——从 OpenAI 宣布与 Figure 共同合作推进人形机器人领域的前沿,到这个视频的发布,只有短短的十三天。

此次 Figure 人形机器人背后的智能,来自端到端的大语言-视觉模型,这是具身智能领域目前非常前沿的领域。去年极客公园报道过谷歌在类似领域的进展。谷歌做出的端到端机器人控制模型,被一些行业内的人士,誉为机器人大模型的 GPT-3 时刻。

而当时,谷歌的机器人模型,还只能根据对话来做一些抓取,并不能与人类对话,也不能向人类解释自己为什么会这么做。而谷歌自身,从 Everyday Robotics 开始,已经有了五年以上的机器人研究经验。

而 Figure 本身,成立于 2022 年。从OpenAI 宣布介入与之合作,到今天它们共同推出一个能够自主对话和决策的机器人,只有 13 天。

机器人智能的发展,显然正在加速。

01. 端到端大模型驱动,机器人的速度已经接近人类速度

Figure 的创始人 Brett Adcock 和 AI 团队的负责人 Corey Lynch 在 X 上解释了此次视频中机器人互动背后的原理。

此次的突破,由 OpenAI 与 Figure 共同做出。OpenAI 提供负责提供视觉推理和语言理解,而 Figure 的神经网络提供快速、低水平、灵巧的机器人动作。

机器人所做出的所有行为都是出于已经学习过,内化了的能力,而不是来自远程操作。

研究人员将机器人摄像头中的图像输入,和机载麦克风捕获的语音中的文本转录到由 OpenAI 训练的,可以理解图像和文本的多模态模型(VLM)中,由该模型处理对话的整个历史记录,得出语言响应,然后通过文本到语音的方式将其回复给人类。

同样的模型,也负责决定在机器人上运行哪些学习的闭环行为来完成给定的命令,将特定的神经网络权重加载到 GPU 上并执行策略。

这也是为什么这个机器人,属于「端到端」的机器人控制。从语言输入开始,模型接管了一切处理,直接输出语言和行为结果,而不是中间输出一些结果,再加载其他程序处理这些结果。

Figure 的机载摄像头以 10hz 的频率拍摄图像,然后神经网络以 200hz 输出 24 个自由度动作。

Figure 的创始人提到,这代表机器人的速度已经有显著提高,开始接近人类的速度。

Corey Lynch 的 X

OpenAI 的模型的多模态能力,是机器人可以与世界交互的关键,我们能够从视频中展示中看到许多类似的瞬间,比如:

描述一下它的周围环境。

做出决定时使用常识推理。例如,「桌子上的盘子和杯子等餐具接下来很可能会进入晾衣架」。

将「我饿了」等模棱两可的高级请求转化为一些适合上下文的行为,例如「递给对方一个苹果」。

用简单的英语描述*为什么*它会执行特定的操作。例如,「这是我可以从桌子上为您提供的唯一可食用的物品」。

而模型能力的强大,使其还能够拥有短期记忆,比如视频中展示的「你能把它们放在那里吗?」「它们」指的是什么?「那里」又在哪里?正确回答需要反思记忆的能力。

而具体的双手动作,可以分成两步来理解:

首先,互联网预训练模型对图像和文本进行常识推理,以得出高级计划。如视频中展示的:Figure 的人形机器人快速形成了两个计划:1)将杯子放在碗碟架上,2)将盘子放在碗碟架上。

其次,大模型以 200hz 的频率生成的 24-DOF 动作(手腕姿势和手指关节角度),充当高速「设定点(setpoint)」,供更高速率的全身控制器跟踪。全身控制器确保安全、稳定的动力,如保持平衡。

所有行为均由神经网络视觉运动 Transformer 策略驱动,将像素直接映射到动作。

02.从 ChatGPT 到 Sora,再到机器人,OpenAI 想包揽「智能」这件事

2021 年夏天,OpenAI 悄悄关闭了其机器人团队,当时,OpenAI 曾宣布无限期终止对机器人领域的探索,原因是缺乏训练机器人使用人工智能移动和推理所需的数据,导致研发受到阻碍。

但显然,OpenAI 并没有放下对这个领域的关注。

2023 年 3 月,正在一年前,极客公园报道了 OpenAI 投资了来自挪威的机器人制造商 1X Technologies。其副总裁正是我在文初提到的,认为具身智能将会突然到来的 Eric Jang。

而无独有偶,1X Technologies 的技术方向,也是端到端的神经网络对于机器人的控制。

而今年 3 月初,OpenAI 和其他投资人一起,参与了 Figure 的 B 轮融资,使其成立两年,就达到了 26 亿美金估值。

也正是在这一轮融资之后,OpenAI 宣布了与 Figure 的合作。

Figure 的创始人 Brett Adcock,是个「擅长组局」的连续创业者,整个职业生涯中创立过至少 7 家公司,其中一家以 27 亿美元的估值上市,一家被 1.1 亿美元的价格收购。

创建公司后,他招募到了研究科学家 Jerry Pratt 担任首席技术官,前波士顿动力/苹果工程师 Michael Rose 担任机器人控制主管。此次进行分享的 AI 团队负责人 Corey Lynch,则原本是 Google Deepmind 的 AI 研究员。

Figure 宣布自己在电机、固件、热量、电子产品、中间件操作系统、电池系统、执行器传感器、机械与结构方面,都招募了硬核的设计人才。

公司的确进展很快。在与 OpenAI 合作之前,已经做出了不少成绩。2024 年 1 月,Figure 01(Figure 的第一款人形机器人) 学会了做咖啡,公司称,这背后引入了端到端神经网络,机器人学会自己纠正错误,训练时长为 10 小时。

Figure 01 引入 AI 学会做咖啡

2 月,公司对外展示 Figure 01 的最新进展,在视频里,这个机器人已经学会搬箱子,并运送到传送带上,但速度只有人类的 16.7%。

甚至在商业化上,也已经迈出了第一步:Figure 宣布与宝马制造公司签署商业协议,将 AI 和机器人技术整合到汽车生产中,部署在宝马位于南卡罗来纳州斯巴达堡的制造工厂。

而在今天的视频展示推文中,Figure 宣布其目标是训练一个世界模型,最终能够卖出十亿个级别的模型驱动的人形机器人。

不过,尽管OpenAI与 Figure的合作进展顺畅,但看起来 OpenAI 并未把宝压在一家机器人公司。

北京时间 3 月 13 日,来自谷歌研究团队、加州大学伯克利分校、斯坦福大学教授等一群研究者新成立的一家机器人 AI 公司 Physical Intelligence,被彭博社爆料也拿到了 OpenAI 的融资。

毫无意外,该公司,也是研究未来能够成为通用机器人系统的人工智能。

多头下注机器人领域,13 天合作做出领先的机器人大模型,OpenAI 在机器人领域意图为何,引人关注。

智能人形机器人,未来不止看马斯克的了。