上世纪末的作品《攻壳机动队》中,全身义体化的素子,怀疑自己是否仍然存在。身体、记忆和其他人的关系,当这些事物都能够被复制,也就无法成为肉身生命的论据。

AI 歌手爆火之时,孙燕姿也在回应里提出类似的观点,你并不特别,你已经是可预测的,而且不幸你也是可定制的。

我们可以加上一句,任何人都是可以被 AI 描述和生成的,哪怕你从未做过某些事情。

鲁迅真的说过,一见短袖子,立刻想到白臂膊。人类的想象力是共通的,毫不意外,每当技术有新进展,某个垂直赛道会被开发得越发成熟:搞黄色。

从明星网红,到每个普通人2017 年兴起的色情 Deepfake 有续集了。

之前是换脸的「移花接木」,眼下是数行文字的「无中生有」。

AI 作图发展到如今,已经有了很多分享 AI 模型的网站,你可以用来生成各种风格的图片,莫奈笔调风景画、韦斯·安德森配色产品图,当然也包括仿佛真人出镜的色情场景。

「Create Anything(创造任何东西)」,这是其中一个网站(避免有宣传之嫌,名字就不透露了)打出的旗号。虽然啥都能干,不少用户更愿意在「十八禁」大展拳脚。

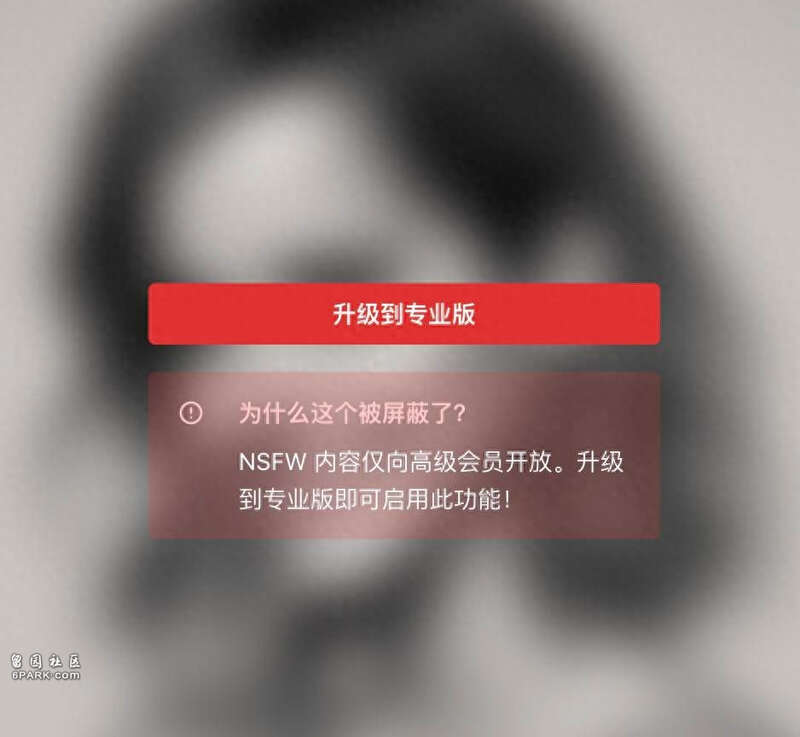

在文本框输入名人名字,加上「裸体」等提示词,就会得到一个模糊的图像。接下来是另外的价钱,每月 4 美元试水基础版,或者每月 15 美元尊享专业版。

▲ 付费解锁界面,NSFW 意为「工作场所不宜」,一般指色情、暴力等内容.

不仅如此,生成图片之后,提示词公开可见,让类似喜好的其他用户沿用或者迭代都很方便。

另外,这个网站在聊天软件 Discord 有 3000 多名成员和数十个聊天室,他们讨论的都是怎么精进提示词技巧,从而更符合自己对某个部位和姿势的想象。

▲ 好莱坞女星的 AI 模型,已经下载 1300 次.

网站的创始人在接受采访时说,NSFW 只占平台内容的一小部分,每月有 100 万个活跃的创作者产出独特的作品。

在另一个类似的网站,用户可以上传、共享和发现自定义模型,同样是什么风格都有,动漫风、游戏风、胶片复古风......但人性所致,带颜色的模型人气居高不下,最热门的几个已经被下载六七万次。

▲ 一个「擦边球」模型.

色情固然是互联网的一部分,然而问题在于,训练这些模型的真实人物图片,是在互联网擅自抓取的,并没有经过本人的同意。

有些图片也不是完全露骨,而是让名人穿着内衣,或者某个部位看起来更大,但五十步笑百步的做法,仍然是不道德的。

这时候就需要稍微解释下原理。很多个性化的 AI 模型,都是基于开源的 Stable Diffusion 微调,而 LoRA 又是一种主流的模型微调训练方法,因为它相对轻量化,用少量图片训练,便能生成特定的人物、物体或画风。

▲ 之前很火的赛博 COSER 用的也是 LoRA. 图片来自:@勘云工造

那么对于色图,谁成为了微调数据集呢?

独立媒体公司 404 Media 调查发现,其中一个模型的训练数据,来自「美版贴吧」Reddit 的几个成人主题社区。

愿意上传图片,不代表愿意充当 AI 的口粮。一位负责管理社区的 Reddit 用户怀疑,大多数在 Reddit 发布裸照的人,可能并不知道照片正在被用来喂养 AI 模型。

倒也不是发出裸照才有威胁。7 月初,德国电信发了一条关于儿童数据安全的广告,展现个人数据被拿去使用是多么容易,后果又是多么严重,呼吁家长尽量少在互联网分享儿童隐私。

▲ 德国电信广告部分截图,儿童照片可能会被用于制造成人内容.

这也意味着,威胁不仅在明星和网红头上盘旋,也可能击中在互联网路过的普通人,恐怕离人人都有一个 AI 模型的未来也不远了,只要你我在互联网上有过数字痕迹。

根据今年 7 月的互联网状况统计报告,近 50 亿人(48.8 亿)活跃在社交媒体上,占世界总人口的 60.6%。

或许有人会问,这不是 Deepfake 换脸时就有的毛病吗?是的,但伪造图片的脚步不会停下,已经存在的问题变本加厉。

从基于生成式对抗网络的 Deepfake,到模拟粒子热运动过程的扩散模型,训练数据集扩大了、算法框架迭代了、算力水平也提升了。更直观的是,普通人在 AI 上也有参与感了。

从前我们更偏向 AI 消费者,或是刷到真假难辨的汤姆·克鲁斯微微一哂,保持看热闹的旁观心态,或是换上好玩的滤镜跟进社交媒体潮流,交出去的基本是自己的个人信息。

▲ TikTok 的「汤姆·克鲁斯」,本人看了也得犯迷糊.

现在我们都可以是 AI 生产者,登录 AI 模型网站,在文本框输入提示词,由云计算处理需求,几分钟就可以生成某位名人的定制 AI 作品,哪怕质量不好,用户规模和图片数量是空前的,每个月产出上百万张图片不在话下。

▲ 某 AI 模型网站的生成速度,最多需要 1 分钟.

AI 成人内容的可怕之处还在于,既要从真人取材,也要回归「真实」。

各网站最受欢迎的模型之一非常强调现实感,用户们还在 Reddit 讨论怎么给某个器官特写。行业里最优秀的创作者,甚至称自己的作品就像「1080P+ 视频的定格帧」。

可想而知,骚扰和勒索也可能会增加,技术的恶面往往最先向无法自保的人刀剑相向。

是兴趣,更是交易和性搭上了边,那就不缺交易。买家是出于个人兴趣,卖家则是因为真金白银。除了上文提到的订阅模式,用 AI 色图赚钱的方式还有很多,虽然基本都是「打零工」。

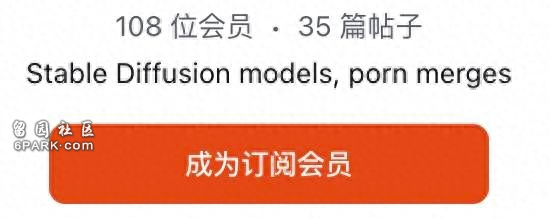

在 Patreon、Ko-fi 等具有打赏、赞助功能的平台,可以找到创作者的踪影。一位创作者在 Patreon 有 100 多名付费会员,巅峰时期每个月能赚到 1500 美元。

他还顺便加入了另外一个平台的「创作者计划」,每张图片入账 0.001 美元,虽然单价低,但好在他使唤 AI 的速度够快。

▲ Patreon 的订阅界面.

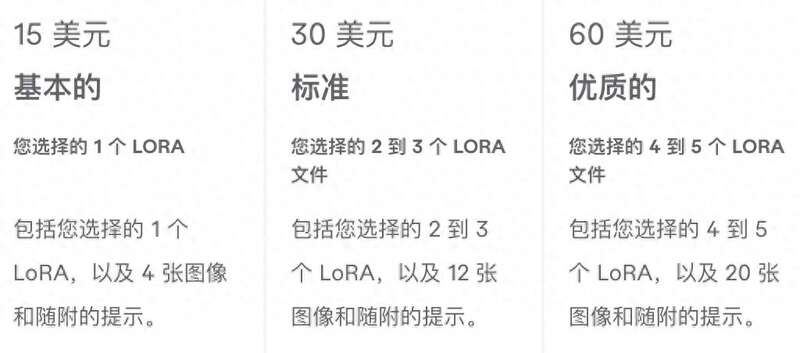

任务众包平台 Fiverr 也值得一提,它是一个连接甲方乙方的中介,几乎可以购买和出售任何数字化「零活」,比如写作、翻译、设计,不少 AI 创作者明码标价,按照模型和图片数量阶梯收费。

▲ 一位 Fiverr 创作者的接活界面.

还有作风更加极客的创作者,直接在 AI 模型网站贴出比特币钱包地址。

别说个体创作者了,平台同样赚得盆满钵满。

有的 AI 模型网站自己也有打赏功能,同时提供每月 5 美元的会员福利,让用户可以抢先体验新功能,并在官网和 Discord 上的用户名后面戴上独特的徽章。

▲ AI 模型网站的打赏功能.

号称全世界第二大成人网站的 OnlyFans,不像 P 站收入主要来自广告并按视频点击量和创作者分成,创作者可以通过用户订阅和按次付费赚钱。

有观点认为,OnlyFans 改变了成人产业,因为创作者拿回了主导权,通过自己的作品直接获得收入。

然而现在,出图更快的「AI 师傅」也在复刻这套商业模式,「传统手艺人」的生财之路可能再次被打断。

这一集我们在 Deepfake 视频大行其道的时候就看过。彭博社采访的一位 29 岁网红,是其中一位惴惴不安的受害者。

放在以前,如果想看她玩电子游戏,可以每月花 5 美元订阅 Twitch,如果想看她尺度更大的内容,可以每月花 15 美元订阅 OnlyFans。

然而现在,粉丝可以花更少的钱或者免费观看她的 Deepfake 视频,只要带着她的大名搜索 Google。与此同时,心理创伤如影随形:

人们总是在发布新视频,在你不同意的情况下看到自己出现在色情片中,感觉很恶心。

AI 色图这把火,也迟早烧到真人头上。一位在 Reddit 发图的「女菩萨」很是悲观:

过去没有采取任何措施来保护我们,所以我不明白为什么现在会激励任何保护措施。

操作猛如虎,维权打地鼠作恶成本低、维权成本高,是 2017 年「黄色」Deepfake 兴起之时就有的毛病了,现在它只会变得更加严重。

撤下未经本人同意的 AI 色图,往往是靠受害者自行发现,或者平台事后补救。

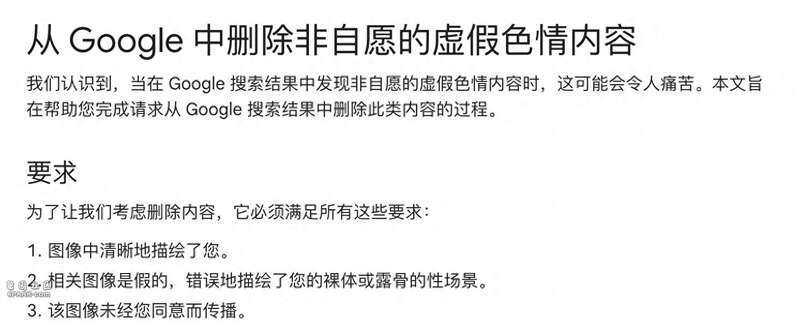

按照 Google 的服务条款,如果证据充分,用户可以请求 Google 删除某条具体的链接。然而「野火烧不尽」,这就像一个没有终点的打地鼠游戏。

不过,Google 也在改进排名系统,减少此类内容的出现。

▲ Google 的服务条款.

提供 AI 模型的平台们也并非没有意识到,技术存在被滥用的可能,但前所未有的内容规模,已经不允许平台只是沿用以前的审核策略。

404 Media 记者发现,某 AI 模型网站的服务条款允许色情内容,也允许真人内容,但不允许两者兼而有之的真人色情内容,尤其涉及到未成年时。

然而,此类内容仍然不断发布,部分被平台删除,部分已经「幸存」了几个月。

▲ 某 AI 模型网站的服务条款.

只能说,意识到位了,但方法没有。对技术的规范,总是相对技术落后半步。

类似地,生成真人色情图像,违反了 Discord 的社区规则,但管理起来并不容易,靠的主要是用户自觉。

Discord 的信任与安全团队,负责检查用户、版主或记者的报告,如果有人确实违反了社区准则,那就发出警告、删除内容、关停账号等,存在一定的被动性。

▲ Discord 的社区准则,上为原文下为翻译.

讽刺的是,把 AI 色图分享到 Discord,也会被 AI 模型网站的用户内部批评,不是问心有愧,而是因为这坏了规矩,有可能让社区被禁:「你可以在网站上创建它,但不能在这里分享。」

甚至法律也不一定派上用场,就像 Deepfake 存在这么久了,美国只有几个州在为它立法,但因为杂乱无章,很难真正执行,并且有些创作者想尽办法隐藏身份,既然找不到人维权,很多时候受害者只能吃下哑巴亏。

好在几个更加主流的文生图工具,用技术为技术事先附加了制约。

OpenAI 旗下的 Dall-E,尽可能减少了训练数据中的裸体图像,并且在实际使用过程中,阻止某些提示词的输入,以及在图片显示给用户之前扫描输出结果。

Midjourney 也有屏蔽词和人工审核,还计划推出更先进的、能够关联上下文的过滤功能。

Stable Diffusion 背后的公司 Stability AI 也曾回应过类似的问题,「对任何开源代码所做的事情都是无法控制的」。

尽管如此,Stability AI 认为,识别此类行为并将其定为犯罪,还有很多事情可以做,开发者社区和互联网基础设施提供商也应该参与进来。

简言之,对技术的规范就像钝刀子割肉,不能立刻起效,而 AI 色图的问题远比以前严重,靠的是一条运行顺畅的「生产链」:

提供训练图像的内容社区;生成色图的开源技术;将 AI 模型和图片商业化的平台;自从 Deepfake 问世,我们就遇到了同样的问题。人性难测,技术的普及和滥用只有一步之遥,工具更加容易上手了,商业模式也走通了,那么创建和分发色图的动力就更大了。

很多时候,互联网的成人行业已经被「非人化」地看待,当真正非人的 AI 取而代之,继续满足刻板印象,可能导致物化更上一层楼,而不是停止物化。

就像《攻壳机动队》提出的问题那样,真实和虚假不再沟壑分明。完全像你的人做出了你从来不会做的事,但你很难证明那不是你,数据就是你,存在过的痕迹就是你。

每当 AI 被最先应用到色情产业,总有人说,这会加速技术普及,或者不再需要真人。有人用金钱兑换欲望,有人不经意被投入技术熔炉,却没有谁会为伤害买单。