高性能GPU受限,会影响国内部分智算中心建设进度

美国政府正在限制对华出售用于数据中心的高性能GPU芯片。数据中心GPU通常用于深度学习训练等场景。AMD、NVIDIA(英伟达)等半导体巨头受到了直接的影响。

8月31日,英伟达、AMD两家知名半导体企业旗下生产的GPU产品被美国列入限制范围。英伟达被限制的产品包括A100和H100,以及搭载上述芯片的DGX服务器。AMD受管制GPU产品包括MI250。

阿里云、腾讯云、百度云等云厂商,联想、新华三、浪潮等服务器制造商,均是英伟达A100 GPU芯片在华重点客户。因此将受到这一限制的影响。

在9月1日的中国外交部、商务部例行记者会上,两部门发言人均对此事做出了回应。外交部发言人称,此举违反市场经济规则,破坏国际经贸秩序。商务部则表示,这一做法损害中国企业的正当权益,也将严重影响美国企业的利益,对全球产业链供应链稳定和世界经济恢复造成冲击。

美国证券交易委员会官网8月31日发布的公告显示,英伟达2022年8月26日接美国政府通知,向中国出售A100、H100、DGX服务器需要经过美国政府许可。未来,峰值性能等于或超过A100的GPU产品也要获取许可证,并且禁止对俄罗斯出售产品,原因是避免军事用途。

公告解释,这会影响A100的后续服务,并影响H100的开发进度。英伟达正在与美国政府合作,为公司对中国的开发、服务活动寻求豁免。此外,英伟达还在为中国客户寻找替代产品。如果替代产品不足,公司会为中国客户申请A100、H100的许可,但不保证能获得授权。

英伟达在公告中表示,将有约4亿美元的对华销售额可能会受到新许可要求的影响。

英伟达A100在2020年推出,是目前全球性能最强的数据中心专用GPU。H100今年3月发布,尚未全面商用,是英伟达面向数据中心的下一代GPU产品。

英伟达2021年财报显示,其数据中心年营收106亿元,约有10%来自中国市场。A100代表的高性能GPU在华销售占比正在持续提升。

芯片许可限制影响了英伟达股价。英伟达(NASDAQ: NVDA)股价在盘中交易时一度下跌6.5%。截至美国西部时间8月31日16时收盘时,英伟达股价下跌3.7%。

尚未正式公布

一位半导体业内人士对《财经十一人》表示,如果细则落地,受影响最大的是阿里云、腾讯云、百度云等云厂商在建、新建的高端商用数据中心。

2021年开始,国内云厂商、服务器制造商都在大规模推出搭载英伟达A100的云服务器产品。

值得注意的是,上述芯片许可限制的执行细则尚未出台。《财经十一人》从国内多家云厂商数据中心业务负责人士得到的消息是,他们暂时未收到英伟达、AMD方面的消息。

“这个细则涉及到美国14纳米以下的芯片,以及逻辑芯片对华出口管制。细则可能很快就会出台。”一位法律人士表示,美国政府目前对英伟达、AMD只是做出了预通知。目的是让厂商提前做好准备。

英伟达A100于2020年推出,是目前全球性能最强的数据中心专用GPU。英伟达2022年二季度财报电话会中透露,特斯拉最新的超级计算机使用超过7000枚A100 GPU进行自动驾驶训练。Facebook在今年初宣布,今年建成的AI研究超级集群至少采用了6080枚A100 GPU。

国内云厂商对A100 GPU的采购数量目前不详。不过,2020年开始,部分领先的云厂商就在采购A100 GPU。一位云厂商数据中心人士对《财经十一人》表示,在智能计算,尤其是AI大模型训练方面,英伟达A100是国内云厂商最主流的选择。

在云计算的算力池中,CPU、GPU是两种不同的算力。前者更多处理通用计算需求,后者处理处理大数据、机器学习和人工智能场景的效率更高。因此,AI大模型训练、AI推理、数据分析、图像分析等场景都有赖于英特尔、AMD、英伟达的GPU芯片。

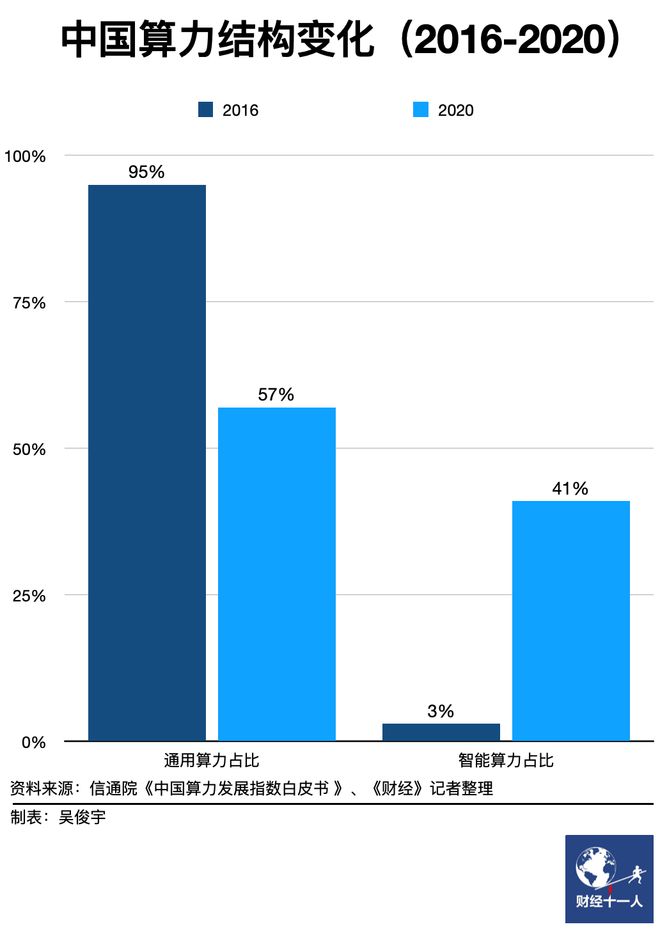

云厂商正在把智能计算作为云计算下个技术阶段的重要方向。中国信通院2021年一组数据显示,通用算力占算力的比重由2016年的95%下降至2020年的57%,智能算力占算力的比重则由2016年的3%提升至2020年41%。

另一位国内数据中心技术人士对《财经十一人》说,一台顶尖的智能算力服务器,通常会搭载1枚-2枚CPU、8枚英伟达A100 GPU。A100 为代表的高性能GPU受限,会影响部分智算中心的建设进度。解决方案是,被迫使用性能更低的替代产品,或靠“堆数量”获得同等规模的算力。带来的直接影响是,同等算力的计算成本提升,一些高精度要求的计算能力下降。

英伟达创始人黄仁勋也在公开渠道表示,将立即与中国客户合作,寻找替代产品或申请许可证。但对需要A100全面性能的客户来说,替代产品性能会不足。但对多数客户而言,替代产品可以满足需求。

相比之下,政府主导的超算中心影响不大。上述半导体业内人士表示,超算中心一般执行单一任务,通常CPU可实现。此外,超算中心建设之初一般会考虑到供应链安全和自主可控,尽可能避免对国外公司芯片的依赖。

倒逼产业链自主化

现实之下,寻找AI算力的替代解决方案成为出路。用于数据中心的GPU芯片通常被称为AI芯片。AI芯片也被称为AI加速器或计算卡,即专门用于处理人工智能应用中的大量计算任务的模块。当前的AI芯片主要分为 GPU(图形处理器)、FPGA(现场可编程逻辑门阵列)、ASIC(特殊应用集成电路)。

若不考虑性能和效率,一个可行的做法是采购未被限制的产品,靠“堆数量”方式解决问题。事实上,无论是英伟达、AMD,仍有性能相对更弱的GPU仍可选择。

一位半导体业内人士打了个比方,AI芯片是一个集群,一个数据中心可能需要几万片AI芯片,高性能芯片,如果需要5000片。那么性能更低的产品,可能就需要2万片。这个做法尽管理论可行,却会带来更高的计算成本。

另一个解决方案是,依靠国产厂商生产的数据中心GPU。但是国产GPU、AI加速芯片目前缺少高端产品,能力相对单一。和英伟达GPU相比,相当于是单项运动员和全能选手。前者可能能够在某一个方面的性能超过英伟达,但从通用性来说,远达不到英伟达的性能。

专利壁垒也是国产GPU或AI加速芯片公司需要解决的问题。多年的技术积累,英伟达已经构筑起了一道专利高墙。如何绕过英伟达专利,是一个挑战。

另一个挑战是生态和适配。国产GPU需要软件适配,更需要时间磨合。对于国产GPU厂商来说,构建生态比设计制造芯片更难。一直以来,英伟达已经搭建了一条完整的生态。

燧原科技CEO赵立东曾向《财经十一人》解释生态的意义,所谓的AI芯片的生态,指的是,芯片之上整个软件栈来支持AI框架,而AI应用程序则是基于这些框架开发的。软件栈包括驱动程序、编译器、函数库、算字库、工具包等,是实现高性能、高通用性、高易用性,以及针对不同应用场景深度优化的关键。

在AI云端训练芯片上,极少有公司能够突破英伟达的生态。英伟达生态形成多年,所有开发者都会顺着这个生态做。重新更换底层芯片,适应新的生态,背后也是巨额的学习成本。

“当然,如果断供之后没有选择,那就只有自主化一条路可以走。再难也要走下去。”上述半导体业内人士表示。这能够倒逼国内AI芯片公司发展——厂商不得不做好随时被断供的准备,有客户,就意味着有机会能够验证和试错,本土企业构建自主生态有了进一步的可能。